Меры и единицы количества и объема информации реферат

Обновлено: 04.07.2024

На этом уровне интересуют последствия от получения и использования данной информации потребителем. Проблемы этого уровня связаны с определением ценности и полезности использования информации при выработке потребителем решения для достижения своей цели. Основная сложность здесь состоит в том, что ценность, полезность информации может быть совершенно различной для различных получателей и, кроме того, она зависит от ряда факторов, таких, например, как своевременность ее доставки и использования.

Для каждого из рассмотренных выше уровней проблем передачи информации существуют свои подходы к измерению количества информации и свои меры информации. Различают соответственно меры информации синтаксического уровня, семантического уроня и прагматического уровня.

Меры информации синтаксического уровня. Количественная оценка информации этого уровня не связана с содержательной стороной информации, а оперирует с обезличенной информацией, не выражающей смыслового отношения к объекту. В связи с этим данная мера дает возможность оценки информационных потоков в таких разных по своей природе объектах, как системы связи, вычислительные машины, системы управления, нервная система живого организма и т. п.

Для измерения информации на синтаксическом уровне вводятся два параметра: объем информации (данных) – Vд (объемный подход) и количество информации – I (энтропийный подход).

В современной вычислительной технике наряду с минимальной единицей измерения данных бит широко используется укрупненная единица измерения байт, равная 8 бит. Именно восемь битов требуется для того, чтобы закодировать любой из 256 символов алфавита клавиатуры компьютера (256=2 8 ).

При работе с большими объемами информации для подсчета ее количества применяют более крупные единицы измерения:

1 Килобайт (Кбайт) = 1024 байт = 2 10 байт,

1 Мегабайт (Мбайт) = 1024 Кбайт = 2 20 байт = 1 048 576 байт;

1 Гигабайт (Гбайт) = 1024 Мбайт = 2 30 байт = 1 073 741 824 байт;

В последнее время в связи с увеличением объёмов обрабатываемой информации входят в употребление такие производные единицы, как:

1 Терабайт (Тбайт) = 1024 Гбайт = 2 40 байт = 1 099 511 627 776 байт;

1 Петабайт (Пбайт) = 1024 Тбайт = 2 50 байт = 1 125 899 906 842 624 байт.

Таким образом, при энтропийном подходе под информацией понимается количественная величина исчезнувшей в ходе какого-либо процесса (испытания, измерения и т.д.) неопределенности. При этом в качестве меры неопределенности вводится энтропия Н, а количество информации равно:

где, Hapr – априорная энтропия о состоянии исследуемой системы или процесса;

Haps – апостериорная энтропия.

Апостериори (от лат. a posteriori – из последующего) – происходящее из опыта (испытания, измерения).

Априори (от лат. a priori – из предшествующего) – понятие, характеризующее знание, предшествующее опыту (испытанию), и независимое от него.

В случае, когда в ходе испытания имевшаяся неопределенность снята (получен конкретный результат, т. е. Н = 0), количество полученной информации совпадает с первоначальной энтропией

Отдельные состояния a1, а2. аn называют буквами или символами алфавита.

Такая система может в каждый момент времени случайным образом принять одно из конечных множеств возможных состояний ai. При этом говорят, что различные состояния реализуются вследствие выбора их источником.

Поясним эту идею на примере.

Пусть у нас имеется 32 различные карты. Возможность выбора одной карты из колоды – 32. До произведения выбора, естественно предложить, что шансы выбрать некоторую определенную карту, одинаковы для всех карт. Произведя выбор, мы устраняем эту неопределенность. При этом неопределенность можно охарактеризовать количеством возможных равновероятностных выборов. Если теперь определить количество информации как меру устранения неопределенности, то полученную в результате выбора информацию можно охарактеризовать числом 32. Однако удобнее использовать не само это число, а логарифм от полученной выше оценки по основанию 2:

где m – число возможных равновероятных выборов (При m=2, получим информацию в один бит). То есть в нашем случае

Если при выборе карты, возможность появления каждой карты не одинаковы (разновероятны), то получим статистический подход к измерению информации, предложенный К. Шенноном (1948 г.). В этом случае мера информации измеряется по формуле:

где pi – вероятность выбора i-го символа алфавита.

Легко заметить, что если вероятности p1, . pn равны, то каждая из них равна 1/N, и формула Шеннона превращается в формулу Хартли.

Тезаурус — совокупность сведений, которыми располагает пользователь или система.

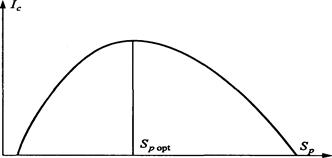

В зависимости от соотношений между смысловым содержанием информации S и тезаурусом пользователя Sp изменяется количество семантической информации Iс, воспринимаемой пользователем и включаемой им в дальнейшем в свой тезаурус. Характер такой зависимости показан на рис. 2.1. Рассмотрим два предельных случая, когда количество семантической информации Iс равно 0:

а) при Sp = 0 пользователь не воспринимает (не понимает) поступающую информацию;

Рис. 1.2. Зависимость количества семантической информации,

воспринимаемой потребителем, от его тезауруса Ic=f(Sp)

Максимальное количество семантической информации потребитель приобретает при согласовании ее смыслового содержания S со своим тезаурусом Sp (S = Sp opt), когда поступающая информация понятна пользователю и несет ему ранее неизвестные (отсутствующие в его тезаурусе) сведения.

При оценке семантического (содержательного) аспекта информации необходимо стремиться к согласованию величин S и Sp.

Относительной мерой количества семантической информации может служить коэффициент содержательности С, который определяется как отношение количества семантической информации к ее объему:

Меры информации прагматического уровня.Эта мера определяет полезность информации для достижения пользователем поставленной цели. Эта мера также величина относительная, обусловленная особенностями использования этой информации в той или иной системе.

Одним из первых российских ученых к проблеме оценки информации прагматического уровня обратился А.А. Харкевич, который предложил принять за меру ценности информации количество информации, необходимое для достижения поставленной цели, т. е. рассчитывать приращение вероятности достижения цели. Так, если до получения информации вероятность достижения цели равнялась р0, а после ее получения – p1 то ценность информации определяется как логарифм отношения p1/p0:

Таким образом, ценность информации при этом измеряется в единицах информации, в данном случае в битах.

Информация – это сведения об окружающем мире (объекте, процессе, явлении, событии), которые являются объектом преобразования (включая хранение, передачу и т.д.) и используются для выработки поведения, для принятия решения, для управления или для обучения.

При всем многообразии подходов к определению понятия информации, с позиции измерения информации выделяют два из них: определение К. Шеннона, применяемое в математической теории информации (содержательный подход), и определение А. Н. Колмогорова, применяемое в отраслях информатики, связанных с использованием компьютеров (алфавитный подход).

Содержательный подход часто называют субъективным, так как разные люди (субъекты) информацию об одном и том же предмете оценивают по-разному.

Но если число исходов не зависит от суждений людей (случай бросания кубика или монеты), то информация о наступлении одного из возможных исходов является объективной.

Единицы измерения информации.

Как уже было сказано, основная единица измерения информации — бит. 8 бит составляют 1 байт.

Наряду с байтами для измерения количества информации используются более крупные единицы:

1 Кбайт (один килобайт) = 210 байт = 1024 байта;

1 Мбайт (один мегабайт) = 210 Кбайт = 1024 Кбайта;

1 Гбайт (один гигабайт) = 210 Мбайт = 1024 Мбайта.

В последнее время в связи с увеличением объёмов обрабатываемой информации входят в употребление такие производные единицы, как:

1 Терабайт (Тб) = 1024 Гбайта = 240 байта,

1 Петабайт (Пб) = 1024 Тбайта = 250 байта.

Билет №6. Устройство памяти компьютера. Носители информации (гибкий диск, жесткий диск, диск CD - ROM / R / RW , DVD и т.д.

Основной функцией внешней памяти компьютера является способность долговременно хранить большой объем информации (программы, документы, аудио-и видеоклипы и т. д.). Устройство, которое обеспечивает запись/считывание информации, называется накопителем или дисководом, а хранится информация на носителях (например, дискетах).

В накопителях на гибких магнитных дисках (НГМД или дискетах) и накопителях на жестких магнитных дисках (НЖМД или винчестерах), в основу записи, хранения и считывания информации положен магнитный принцип, а в лазерных дисководах — оптический принцип.

1. Гибкие магнитные диски помещаются в пластмассовый корпус. Такой носитель информации называется дискетой. Дискета вставляется в дисковод, вращающий диск с постоянной угловой скоростью. Магнитная головка дисковода устанавливается на определенную концентрическую дорожку диска, на которую и записывается (или считывается) информация.

Информационная ёмкость дискеты невелика и составляет всего 1.44 Мбайт. Скорость записи и считывания информации также мала (около 50 Кбайт/с) из-за медленного вращения диска (360 об./мин).

В целях сохранения информации гибкие магнитные диски следует предохранять от воздействия сильных магнитных полей и нагревания, так как это может привести к размагничиванию носителя и потере информации.

2. Жесткий диск (HDD — Hard Disk Drive) относится к несменным дисковым магнитным накопителям. Первый жесткий диск был разработан фирмой IBM в 1973 г. и имел емкость 16 Кбайт.

Жесткие магнитные диски представляют собой несколько десятков дисков, размещенных на одной оси, заключенных в металлический корпус и вращающихся с высокой угловой скоростью. За счет множества дорожек на каждой стороне дисков и большого количества дисков информационная емкость жестких дисков может в десятки тысяч раз превышать информационную емкость дискет и достигать сотен Гбайт. Скорость записи и считывания информации с жестких дисков достаточно велика (около 133 Мбайт/с) за счет быстрого вращения дисков (7200 об./мин). Часто жесткий диск называют винчестер.

В жестких дисках используются достаточно хрупкие и миниатюрные элементы. Чтобы сохранить информацию и работоспособность жестких дисков, необходимо оберегать их от ударов и резких изменений пространственной ориентации в процессе работы.

3. Лазерные дисководы и диски. За последние несколько лет компьютерные устройства для чтения компакт-дисков (CD), называемые CD-ROM, стали практически необходимой частью любого компьютера. Это произошло потому, что разнообразные программные продукты стали занимать значительное количество места, и поставка их на дискетах оказалась чрезмерно дорогостоящей и ненадёжной. Поэтому их стали поставлять на CD (таких же, как и обычные музыкальные).

Лазерные дисководы используют оптический принцип чтения информации. На лазерных дисках CD (CD — Compact Disk, компакт диск) и DVD (DVD — Digital Video Disk, цифровой видеодиск) информация записана на одну спиралевидную дорожку (как на грампластинке), содержащую чередующиеся участки с различной отражающей способностью. Лазерный луч падает на поверхность вращающегося диска, а интенсивность отраженного луча зависит от отражающей способности участка дорожки и приобретает значения 0 или 1. Для сохранности информации лазерные диски надо предохранять от механических повреждений (царапин), а также от загрязнения.

На лазерных дисках хранится информация, которая была записана на них в процессе изготовления. Запись на них новой информации невозможна. Производятся такие диски путем штамповки. Существуют CD-R и DVD-R диски информация на которые может быть записана только один раз. На дисках CD-RW и DVD-RW информация может быть записана/перезаписана многократно. Диски разных видов можно отличить не только по маркировки, но и по цвету отражающей поверхности.

Запись на CD и DVD при помощи обычных CD-ROM и DVD-ROM невозможна. Для этого необходимы устройства CD-RW и DVD-RW с помощью которых возможны чтение-однократная запись и чтение-запись-перезапись. Эти устройства обладают достаточно мощным лазером, позволяющем менять отражающую способность участков поверхности в процессе записи диска.

Информационная ёмкость CD-ROM достигает 700 Мбайт, а скорость считывания информации (до 7.8 Мбайт/с) зависит от скорости вращения диска. DVD-диски имеют гораздо большую информационную ёмкость (однослойный односторонний диск - 4.7 Гбайт) по сравнению с CD-дисками, т.к. используются лазеры с меньшей длинной волны, что позволяет размещать оптические дорожки более плотно. Так же существуют двухслойные DVD-диски и двухсторонние DVD-диски. В настоящее время скорости считывания 16-скоростных DVD-дисководов достигает 21 Мбайт/с.

4. Устройства на основе flash-памяти. Flash-память - это энергонезависимый тип памяти, позволяющий записывать и хранить данные в микросхемах. Устройства на основе flash-памяти не имеют в своём составе движущихся частей, что обеспечивает высокую сохранность данных при их использовании в мобильных устройствах.

Flash-память представляет собой микросхему, помещенную в миниатюрный корпус. Для записи или считывания информации накопители подключаются к компьютеру через USB-порт. Информационная емкость карт памяти достигает 1024 Мбайт.

Билет №5. Функциональная схема компьютера (основные устройства, их функции и взаимосвязь).

По своему назначению компьютер - это универсальный прибор для работы с информацией. По принципам своего устройства компьютер - это модель человека, работающего с информацией.

Персональный компьютер (ПК) — это компьютер, предназначенный для обслуживания одного рабочего места. По своим характеристикам он может отличаться от больших ЭВМ, но функционально способен выполнять аналогичные операции. По способу эксплуатации различают настольные (desktop), портативные (laptop и notebook) и карманные (palmtop) модели ПК.

Аппаратное обеспечение. Поскольку компьютер предоставляет все три класса информационных методов для работы с данными (аппаратные, программные и естественные), принято говорить о компьютерной системе как о состоящей из аппаратных и программных средств, работающих совместно. Узлы, составляющие аппаратные средства компьютера, называют аппаратным обеспечением. Они выполняют всю физическую работу с данными: регистрацию, хранение, транспортировку и преобразование как по форме, так и по содержанию, а также представляют их в виде, удобном для взаимодействия с естественными информационными методами человека.

Совокупность аппаратных средств компьютера называют его аппаратной конфигурацией.

Когда программа находится в активном состоянии, содержательная часть ее данных рассматривается как команды, согласно которым работают аппаратные средства компьютера. Чтобы изменить порядок их работы, достаточно прервать исполнение одной программы и начать исполнение другой, содержащей иной набор команд.

Совокупность программ, хранящихся на компьютере, образует его программное обеспечение.Совокупность программ, подготовленных к работе, называют установленным программным обеспечением. Совокупность программ, работающих в тот или иной момент времени, называют программной конфигурацией.

Устройство компьютера. Любой компьютер (даже самый большой) состоит из четырех частей:

· устройства ввода информации

· устройства обработки информации

· устройства вывода информации.

Конструктивно эти части могут быть объединены в одном корпусе размером с книгу или же каждая часть может состоять из нескольких достаточно громоздких устройств

Базовая аппаратная конфигурация ПК. Базовой аппаратной конфигурацией персонального компьютера называют минимальный комплект аппаратных средств, достаточный для начала работы с компьютером. С течением времени понятие базовой конфигурации постепенно меняется.

Чаще всего персональный компьютер состоит из следующих устройств:

1. Системный блок — основной блок компьютерной системы. В нем располагаются устройства, считающиеся внутренними. Устройства, подключаемые к системному блоку снаружи, считаются внешними. Для внешних устройств используют также термин периферийное оборудование.

2. Монитор — устройство для визуального воспроизведения символьной и графической информации. Служит в качестве устройства вывода. Для настольных ПК в настоящее время наиболее распространены мониторы, основанные на электронно-лучевых трубках. Они отдаленно напоминают бытовые телевизоры.

3. Клавиатура — клавишное устройство, предназначенное для управления работой компьютера и ввода в него информации. Информация вводится в виде алфавитно-цифровых символьных данных.

Дополнительно могут подключатся другие устройства ввода и вывода информации, например звуковые колонки, принтер, сканер и др.

Внутренние устройства персонального компьютера. Внутренними считаются устройства, располагающиеся в системном блоке. Доступ к некоторым из них имеется на лицевой панели, что удобно для быстрой смены информационных носителей, например гибких магнитных дисков. Разъемы некоторых устройств выведены на заднюю стенку — они служат для подключения периферийного оборудования. К некоторым устройствам системного блока доступ не предусмотрен — для обычной работы он не требуется.

Процессор. Микропроцессор — основная микросхема персонального компьютера. Все вычисления выполняются в ней. Основная характеристика процессора — тактовая частота (измеряется в мегагерцах, МГц). Чем выше тактовая частота, тем выше производительность процессора. Так, например, при тактовой частоте 500 МГц процессор может за одну секунду изменить свое состояние 500 миллионов раз. Для большинства операций одного такта недостаточно, поэтому количество операций, которые процессор может выполнить в секунду, зависит не только от тактовой частоты, но и от сложности операций.

Оперативная память. Оперативную память можно представить как обширный массив ячеек, в которых хранятся числовые данные и команды в то время, когда компьютер включен. Объем оперативной памяти измеряется в миллионах байтов — мегабайтах (Мбайт).

Процессор может обратиться к любой ячейке оперативной памяти (байту), поскольку она имеет неповторимый числовой адрес. Обратиться к индивидуальному биту оперативной памяти процессор не может, так как у бита нет адреса. В то же время, процессор может изменить состояние любого бита, но для этого требуется несколько действий.

Материнская плата. Материнская плата — это самая большая плата персонального компьютера. На ней располагаются магистрали, связывающие процессор с оперативной памятью, — так называемые шины. Различают шину данных, по которой процессор копирует данные из ячеек памяти, адресную шину, по которой он подключается к конкретным ячейкам памяти, и шину команд, по которой в процессор поступают команды из программ. К шинам материнской платы подключаются также все прочие внутренние устройства компьютера. Управляет работой материнской платы микропроцессорный набор микросхем — так называемый чипсет.

Видеоадаптер. Видеоадаптер — внутреннее устройство, устанавливаемое в один из разъемов материнской платы. В первых персональных компьютерах видеоадаптеров не было. Вместо них в оперативной памяти отводилась небольшая область для хранения видеоданных. Специальная микросхема (видеоконтроллер) считывала данные из ячеек видеопамяти и в соответствии с ними управляла монитором.

По мере улучшения графических возможностей компьютеров область видеопамяти отделили от основной оперативной памяти и вместе с видеоконтроллером выделили в отдельный прибор, который назвали видеоадаптером. Современные видеоадаптеры имеют собственный вычислительный процессор (видеопроцессор), который снизил нагрузку на основной процессор при построении сложных изображений. Особенно большую роль видеопроцессор играет при построении на плоском экране трехмерных изображений. В ходе таких операций ему приходится выполнять особенно много математических расчетов.

В некоторых моделях материнских плат функции видеоадаптера выполняют микросхемы чипсета — в этом случае говорят, что видеоадаптер интегрирован с материнской платой. Если же видеоадаптер выполнен в виде отдельного устройства, его называют видеокартой. Разъем видеокарты выведен на заднюю стенку. К нему подключается монитор.

Звуковой адаптер. В настоящее время средства для работы со звуком считаются стандартными. Для этого на материнской плате устанавливается звуковой адаптер. Он может быть интегрирован в чипсете материнской платы или выполнен как отдельная подключаемая плата, которая называется звуковой картой.

Разъемы звуковой карты выведены на заднюю стенку компьютера. Для воспроизведения звука к ним подключают звуковые колонки или наушники. Отдельный разъем предназначен для подключения микрофона. При наличии специальной программы это позволяет записывать звук. Имеется также разъем (линейный выход) для подключения к внешней звукозаписывающей или звуковоспроизводящей аппаратуре (магнитофонам, усилителям и т.п.).

Жесткий диск. Поскольку оперативная память компьютера очищается при отключении питания, необходимо устройство для длительного хранения данных и программ. В настоящее время для этих целей широко применяют так называемые жесткие диски. Принцип действия жесткого диска основан на регистрации изменений магнитного поля вблизи записывающей головки.

Основным параметром жесткого диска является емкость, измеряемая в гигабайтах (миллиардах байтов), Гбайт. Средний размер современного жесткого диска составляет 80 — 160 Гбайт, причем этот параметр неуклонно растет.

Дисковод гибких дисков. Для транспортировки данных между удаленными компьютерами используют так называемые гибкие диски. Стандартный гибкий диск (дискета) имеет сравнительно небольшую емкость 1,44 Мбайт. По современным меркам этого совершенно недостаточно для большинства задач хранения и транспортировки данных, но низкая стоимость носителей и высокая степень готовности к работе сделали гибкие диски самыми распространенными носителями данных.

Для записи и чтения данных, размещенных на гибких дисках, служит специальное устройство — дисковод. Приемное отверстие дисковода выведено на лицевую панель системного блока.

Дисковод CD-ROM. Для транспортировки больших объемов данных удобно использовать компакт-диски CD-ROM. Эти диски позволяют только читать ранее записанные данные — производить запись на них нельзя. Емкость одного диска составляет порядка 650-700 Мбайт.

Для чтения компакт-дисков служат дисководы CD-ROM. Основной параметр дисковода CD-ROM— скорость чтения. Она измеряется в кратных единицах. За единицу принята скорость чтения, утвержденная в середине 80-х гг. для музыкальных компакт-дисков (аудиодисков). Современные дисководы CD-ROM обеспечивают скорость чтения 40х - 52х.

Основной недостаток дисководов CD-ROM — невозможность записи дисков — преодолен в современных устройствах однократной записи — CD-R. Существуют также устройства CD-RW, позволяющие осуществлять многократную запись.

Принцип хранения данных на компакт-дисках не магнитный, как у гибких дисков, а оптический.

Коммуникационные порты. Для связи с другими устройствами, например принтером, сканером, клавиатурой, мышью и т. п., компьютер оснащается так называемыми портами. Порт — это не просто разъем для подключения внешнего оборудования, хотя порт и заканчивается разъемом. Порт — более сложное устройство, чем просто разъем, имеющее свои микросхемы и управляемое программно.

Сетевой адаптер. Сетевые адаптеры необходимы компьютерам, чтобы они могли обмениваться данными между собой. Этот прибор следит за тем, чтобы процессор не подал новую порцию данных на внешний порт, пока сетевой адаптер соседнего компьютера не скопировал к себе предыдущую порцию. После этого процессору дается сигнал о том, что данные забраны и можно подавать новые. Так осуществляется передача.

Сетевые адаптеры могут быть встроены в материнскую плату, но чаще устанавливаются отдельно, в виде дополнительных плат, называемых сетевыми картами.

Меры и единицы количества и объема информации ( реферат , курсовая , диплом , контрольная )

В теории информации используются объемный и вероятностный (семантический), алгоритмический, семантический и аксиологический подходы.

Объемный подход

В двоичной системе счисления знаки О и 1 называют битами (от англ. " Binary digiTs" - двоичные цифры). Отдают предпочтение именно двоичной системе счисления, потому что она самая простая для реализации в компьютере и реализуется с помощью двух противоположных физических состояний: намагничено/ненамагничено, вкл./выкл., заряжено/незаряжено и др.

Объем информации, записанной двоичными знаками в памяти компьютера или на внешнем носителе информации, подсчитывается просто по количеству требуемых для такой записи двоичных символов. При этом невозможно нецелое число битов.

Для удобства использования введены и более крупные, чем бит, единицы количества информации. Так, двоичное слово из восьми знаков содержит один байт информации (200 = 1 байт), 210 = = 1024 байта образуют один килобайт (1 Кбайт), 220 = 1024 Кбайта — один мегабайт (1 Мбайт), 230 = 1024 Мбайта — один гигабайт (1 Гбайт), а 240 = 1024 Гбайт — один терабайт (1 Тбайт). Таким образом, для десятичной системы счисления имеется ряд 1000, 1001, 1002, 1003, 1004, а для двоичной — 200, 210, 220, 230, 240.

Вероятностный (энтропийный) подход

Энтропия — это общая мера неопределенностей. Она характеризуется некоторой математической зависимостью от совокупности вероятностей наступления этих событий.

Обозначим через неопределенность, имеющуюся до совершения события, а через - неопределенность после наступления события. Тогда за I — количество информации об исходе опыта — примем разность неопределенностей до и после опыта:

В случае когда получен конкретный результат, имевшаяся неопределенность снята (так как ). Таким образом, количество полученной информации совпадает с первоначальной энтропией. Неопределенность, заключенная в опыте, совпадает с информацией об исходе этого опыта.

Определим функцию . Будем варьировать N (число возможных исходов) и М (число опытов). Общее число исходов.

Каждый исход — некоторый вектор длины М, состоящий из знаков .

Ситуацию с проведением М опытов можно рассматривать как некую сложную систему, состоящую из независимых друг от друга подсистем — однократных опытов. Энтропия такой системы в М раз больше, чем энтропия одной системы (так называемый принцип аддитивности энтропии):

Прологарифмируем левую и правую части равенства :

Подставив полученное для М значение в равенство , запишем:

Обозначив положительную константу , получим следующую формулу:

Таким образом, . Обычно принимают , тогда.

Полученная формула называется формулой Хартли.

Важным при введении какой-либо величины является вопрос о том, что принимать за единицу ее измерения. Очевидно, Н будет равно единице при . Иначе говоря, в качестве единицы принимается количество информации, связанное с проведением опыта, состоящего в получении одного из двух равновероятных исходов (например, бросание монеты). Такая единица количества информации называется битом.

При этом вероятность его исхода равняется ' Таким образом:

Эта же (последняя) формула принимается за меру энтропии в случае, когда вероятности различных исходов опыта неравновероятны, т. е. значения могут различаться. Эта формула называется формулой Шеннона.

- Для учеников 1-11 классов и дошкольников

- Бесплатные сертификаты учителям и участникам

Общая характеристика процессов сбора, передачи, обработки, накопления информации……………………………………………………………………….….2

Алфавитный (объёмный) подход к измерению информации……………………………………………………………………..……5

Содержательный подход к измерению информации………………………………..…………………………………………6

Понятие информации

Информация – сведения об объектах и явлениях окружающей среды, их параметрах, свойствах и состоянии, которые уменьшают имеющуюся о них степень неопределенности, неполноты знаний.

Информация, представленная в виде, пригодном для обработки (человеком, компьютером), называется данными. Данные могут быть, например, числовыми, текстовыми, графическими.

Чтобы происходил обмен информацией, должны быть источник информации, передатчик, канал связи, приемник и получатель. Обычно в качестве получателя выступает человек, который оценивает информацию с точки зрения ее применимости для решения поставленной задачи. Процедура оценки информации проходит в три этапа, определяющие ее синтаксический, семантический и прагматический аспекты.

Определенный набор данных вне зависимости от смысловых и потребительских качеств характеризует синтаксический аспект информации. Сопоставление данных с тезаурусом (тезаурус – полный систематизированный набор данных и знаний в какой-либо области) формирует знание о наблюдаемом факте, это является семантическим аспектом информации (отражает смысловое содержание информации). Оценка практической полезности информации отражает ее прагматический аспект.

и накопления информации

Сбор информации – это процесс получения информации из внешнего мира и приведение

ее к стандарту для данной информационной системы. Обмен информацией между воспринимающей ее системой и окружающей средой осуществляется посредством сигналов. Сигнал – средство передачи информации в пространстве и времени. В качестве носителя сигнала могут выступать звук, свет, электрический ток, магнитное поле и т.д.

Сбор информации, как правило, сопровождается ее регистрацией, т.е. фиксацией информации на материальном носителе (документе или машинном носителе).

Передача информации осуществляется различными способами: с помощью курьера, пересылка по почте, доставка транспортными средствами, дистанционная передача по каналам связи. Для осуществления последней необходимы специальные технические средства. Дистанционно может передаваться как первичная информация с мест ее возникновения, так и результатная информация в обратном направлении. Поступление информации по каналам связи осуществляется двумя способами: на машинном носителе и непосредственно в компьютер при помощи специальных программных и аппаратных средств.

Преобразование (обработка) информации – внесение изменений в набор данных, вычисления, информационный поиск, сортировка, построение графиков и т.п. В современных развитых информационных системах машинная обработка информации предполагает последовательно-параллельное во времени решение вычислительных задач. Это возможно при наличии определенной организации вычислительного процесса. Вычислительная задача по мере необходимости обращается с запросами в вычислительную систему. Организация процесса предполагает определение последовательности решения задач и реализацию вычислений. Последовательность решения задается, исходя из информационной взаимосвязи, когда результаты решения одной задачи используются как исходные данные для решения другой. Технология электронной обработки информации – человеко-машинный процесс исполнения взаимосвязанных операций, протекающих в установленной последовательности с целью преобразования исходной информации (первичной) в результатную. Операция представляет собой комплекс совершаемых технологических действий, в результате которых информация преобразуется. Технологические операции разнообразны по сложности, назначению, технике реализации, выполняются на различном оборудовании разными исполнителями.

Хранение и накопление информации вызвано многократным ее использованием, применением постоянной информации, необходимостью комплектации первичных данных до их обработки. Хранение осуществляется на машинных носителях в виде информационных массивов, где данные располагаются по установленному в процессе проектирования группировочному признаку

Свойства информации

Информация характеризуется определенными свойствами, зависящими как от данных (содержательной части информации), так и от методов работы с ними. Свойства информации делятся на две группы: атрибутивные и потребительские .

Атрибутивные свойства — это свойства, которые отображают внутреннюю природу информации и особенности ее использования. Наиболее важными из этих свойств являются следующие:

· информация представляет новые сведения об окружающем мире, отсутствовавшие до ее получения;

· информация не материальна несмотря на то, что она проявляется в форме знаков и сигналов на материальных носителях;

· знаки и сигналы могут предоставить информацию только для получателя, способного их воспринять и распознать;

· информация неотрывна от физического носителя, но в то же время не связана ни с конкретным носителем, ни с конкретным языком;

· информация непрерывна – она накапливается и развивается поступательно .

Качество информации определяется ее свойствами, отвечающими потребностям пользователя.

Рассмотрим наиболее важные потребительские свойства информации:

Полнота (достаточность) информации. Под полнотой информации понимают ее достаточность для принятия решений.

Достоверность информации. Под достоверностью информации понимают ее соответствие объективной реальности окружающего мира. Свойство достоверности информации имеет важное значение в тех случаях, когда ее используют для принятия решений.

Адекватность информации – это степень соответствия информации, полученной потребителем, тому, что автор вложил в ее содержание.

Доступность информации – это мера возможности получить ту или иную информацию.

Актуальность информации – это степень соответствия информации текущему моменту времени. Нередко с актуальностью, как и с полнотой, связывают коммерческую ценность информации. Поскольку информационные процессы растянуты во времени, то достоверная и адекватная, но устаревшая информация может приводить к ошибочным решениям.

При алфавитном подходе, если допустить, что все символы алфавита встречаются в тексте с одинаковой частотой (равновероятно), то количество информации, которое несет каждый символ (информационный вес одного символа), вычисляется по формуле Хартли. (Ральф Винтон Лайон Хартли (англ. Ralph Vinton Lyon Hartley, 30 ноября 1888, Спрус, Невада — 1 мая 1970, Нью-Джерси) — американский учёный-электронщик. Он предложил генератор Хартли, преобразование Хартли и сделал вклад в теорию информации, введя в 1928 году логарифмическую меру информации, которая называется хартлиевским количеством информации или просто мерой Хартли.)

где N – мощность алфавита (полное количество символов, составляющих алфавит выбранного кодирования). Тогда мощность алфавита можно вычислить по формуле

В алфавите, который состоит из двух символов (двоичное кодирование), каждый символ несет 1 бит (log22 = 1) информации.

Если весь текст состоит из k символов, то при алфавитном подходе размер содержащейся в нем информации H определяется по формуле

H = k · I, где I – информационный вес одного символа в используемом алфавите.

Максимальное количество слов L из m букв, которое можно составить из алфавита мощностью N, определяется по формуле

Содержательный подход к измерению информации

Неопределенность некоторого события – это количество возможных исходов данного события.

Например, неопределенность погоды на завтра обычно заключается в диапазоне температуры воздуха и возможности выпадения осадков.

Содержательный подход часто называют субъективным, так как разные люди (субъекты) информацию об одном и том же предмете оценивают по-разному. Но если число исходов не зависит от суждений людей (например, случай бросания кубика или монеты), то информация о наступлении одного из возможных исходов является объективной.

Количество информации для событий с различными вероятностями определяется по формуле (эту формулу также называют формулой Шеннона),

Если события равновероятны (pi = 1/N, где N – число возможных событий),

то величина количества информации I вычисляется по формуле Р. Хартли:

Используя формулу (1), можно записать и формулу, которая связывает количество возможных событий N и количество информации I

Читайте также: