Информация и сообщение мера информации

Обновлено: 11.05.2024

Понятие "информация" имеет различные трактовки в разных предметных областях. Например, информация может пониматься как:

- абстракция, абстрактная модель рассматриваемой системы (в математике);

- сигналы для управления, приспособления рассматриваемой системы (в кибернетике);

- мера хаоса в рассматриваемой системе (в термодинамике);

- вероятность выбора в рассматриваемой системе (в теории вероятностей);

- мера разнообразия в рассматриваемой системе (в биологии) и др.

Рассмотрим это фундаментальное понятие информатики на основе понятия "алфавит" ("алфавитный", формальный подход). Дадим формальное определение алфавита .

Алфавит – конечное множество различных знаков, символов, для которых определена операция конкатенации (приписывания, присоединения символа к символу или цепочке символов); с ее помощью по определенным правилам соединения символов и слов можно получать слова (цепочки знаков) и словосочетания (цепочки слов ) в этом алфавите (над этим алфавитом ).

Буквой или знаком называется любой элемент x алфавита X , где . Понятие знака неразрывно связано с тем, что им обозначается ("со смыслом"), они вместе могут рассматриваться как пара элементов (x, y) , где x – сам знак, а y – обозначаемое этим знаком.

Пример. Примеры алфавитов : множество из десяти цифр, множество из знаков русского языка, точка и тире в азбуке Морзе и др. В алфавите цифр знак 5 связан с понятием "быть в количестве пяти элементов".

Конечная последовательность букв алфавита называется словом в алфавите (или над алфавитом ).

Длиной |p| некоторого слова p над алфавитом Х называется число составляющих его букв .

Слово (обозначаемое символом ) имеющее нулевую длину , называется пустым словом : | | = 0.

Множество различных слов над алфавитом X обозначим через S(X) и назовем словарным запасом (словарем) алфавита (над алфавитом ) X .

В отличие от конечного алфавита , словарный запас может быть и бесконечным.

В алфавите должен быть определен порядок следования букв (порядок типа "предыдущий элемент – последующий элемент"), то есть любой алфавит имеет упорядоченный вид X = 1, x2, …, xn> .

Таким образом, алфавит должен позволять решать задачу лексикографического (алфавитного) упорядочивания, или задачу расположения слов над этим алфавитом , в соответствии с порядком, определенным в алфавите (то есть по символам алфавита ).

Информация по отношению к источнику или приемнику бывает трех типов: входная, выходная и внутренняя.

Информация по отношению к конечному результату бывает исходная, промежуточная и результирующая.

Информация по ее изменчивости бывает постоянная, переменная и смешанная.

Информация по стадии ее использования бывает первичная и вторичная.

Информация по ее полноте бывает избыточная, достаточная и недостаточная.

Информация по доступу к ней бывает открытая и закрытая.

Есть и другие типы классификации информации .

Пример. В философском аспекте информация делится на мировоззренческую, эстетическую, религиозную, научную, бытовую, техническую, экономическую, технологическую.

Классификация мер

Для измерения информации вводятся два параметра: количество информации I и объем данных VД.

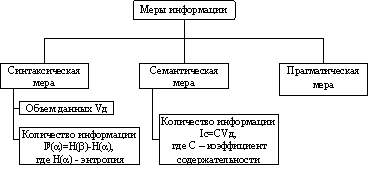

Эти параметры имеют разные выражения и интерпретацию в зависимости от рассматриваемой формы адекватности. Каждой форме адекватности соответствует своя мера количества информации и объема данных (рис. 2.1).

Рис. 2.1. Меры информации

Синтаксическая мера информации

Эта мера количества информации оперирует с обезличенной информацией, не выражающей смыслового отношения к объекту.

• в двоичной системе счисления единица измерения — бит (bit — binary digit — двоичный разряд);

Примечание. В современных ЭВМ наряду с минимальной единицей измерения данных "бит" широко используется укрупненная единица измерения "байт", равная 8 бит.

• в десятичной системе счисления единица измерения — дат (десятичный разряд).

Количество информации I на синтаксическом уровне невозможно определить без рассмотрения понятия неопределенности состояния системы (энтропии системы). Действительно, получение информации о какой-либо системе всегда связано с изменением степени неосведомленности получателя о состоянии этой системы. Рассмотрим это понятие.

Пусть до получения информации потребитель имеет некоторые предварительные (априорные) сведения о системе α. Мерой его неосведомленности о системе является функция H(α), которая в то же время служит и мерой неопределенности состояния системы.

т.е. количество информации измеряется изменением (уменьшением) неопределенности состояния системы.

Если конечная неопределенность Hβ(α) обратится в нуль, то первоначальное неполное знание заменится полным знанием и количество информации Iβ(α) = H(α). Иными словами, энтропия системы H(α) может рассматриваться как мера недостающей информации.

Энтропия системы H(α), имеющая N возможных состояний, согласно формуле Шеннона, равна:

где pi — вероятность того, что система находится в i-м состоянии.

Дня случая, когда все состояния системы равновероятны, т.е. их вероятности равны Pi =, ее энтропия определяется соотношением

Часто информация кодируется числовыми кодами в той или иной системе счисления, особенно это актуально при представлении информации в компьютере. Естественно, что одно и то же количество разрядов в разных системах счисления может передать разное число состояний отображаемого объекта, что можно представить в виде соотношения

где N — число всевозможных отображаемых состояний;

Информация - сведения об объектах и явлениях окружающей среды, их параметрах, свойствах и состоянии, которые уменьшают имеющуюся о них степень неопределенности, неполноты знаний.

Информатика рассматривает информацию как концептуально связанные между собой сведения, данные, понятия, изменяющие наши представления о явлении или объекте окружающего мира. Наряду c информацией в информатике часто употребляется понятие данные. Покажем, в чем их отличие.

Данные могут рассматриваться как признаки или записанные наблюдения, которые по каким-то причинам не используются, а только хранятся. В том случае, если появляется возможность использовать эти данные для уменьшения неопределенности о чем-либо, данные превращаются в информацию. Поэтому можно утверждать, что информацией являются используемые данные.

Пример 2.1. Напишите на листе десять номеров телефонов в виде последовательности десяти чисел и покажите их вашему другу. Он воспримет эти цифры как данные, так как они не предоставляют ему никаких сведений

Затем против каждого номера укажите название фирмы и род деятельности. Для вашего друга непонятные цифры обретут определенность и превратятся из данных в информацию, которую он в дальнейшем мог бы использовать.

Одной из важнейших разновидностей информации является информация экономическая. Ее отличительная черта - связь с процессами управления коллективами людей, организацией. Экономическая информация сопровождает процессы производства, распределения, обмена и потребления материальных благ и услуг. Значительная часть ее связана с общественным производством и может быть названа производственной информацией.

Экономическая информация - овокупность сведений, отражающих социально-экономические процессы и служащих для управления этими процессами и коллективами людей в производственной и непроизводственной сфере.

Для потребителя информации очень важной характеристикой является ее адекватность.

Адекватность информации - это определенный уровень соответствия создаваемого с помощью полученной информации образа реальному объекту, процессу, явлению и т.п.

В реальной жизни вряд ли возможна ситуация, когда вы сможете рассчитывать на полную адекватность информации. Всегда присутствует некоторая степень неопределенности. От степени адекватности информации реальному состоянию объекта или процесса зависит правильность принятия решений человеком.

Пример 2.2. Вы успешно закончили школу и хотите продолжить образование по экономическому направлению. Поговорив с друзьями, вы узнаете, что подобную подготовку можно получить в разных вузах. В результате таких бесед вы получаете весьма разноречивые сведения, которые не позволяют вам принять решение в пользу того или иного варианта, т.е. полученная информация неадекватна реальному состоянию дел. Для того чтобы получить более достоверные сведения, вы покупаете справочник для поступающих в вузы, из которого получаете исчерпывающую информацию. В этом случае можно говорить, что информация, полученная вами из справочника, адекватно отражает направления обучения в вузах и помогает вам определиться в окончательном выборе.

ФОРМЫ АДЕКВАТНОСТИ ИНФОРМАЦИИ

Адекватность информации может выражаться в трех формах: семантической, синтаксической, прагматической.

Синтаксическая адекватность. Она отображает формально-структурные характеристики информации и не затрагивает ее смыслового содержания. На синтаксическом уровне учитываются тип носителя и способ представления информации, скорость передачи и обработки, размеры кодов представления информации, надежность и точность преобразования этих кодов и т.п. Информацию, рассматриваемую только с синтаксических позиций, обычно называют данными, так как при этом не имеет значения смысловая сторона. Эта форма способствует восприятию внешних структурных характеристик, т.е. синтаксической стороны информации.

Семантическая (смысловая) адекватность. Эта форма определяет степень соответствия образа объекта и самого объекта. Семантический аспект предполагает учет смыслового содержания информации. На этом уровне анализируются те сведения, которые отражает информация, рассматриваются смысловые связи. В информатике устанавливаются смысловые связи между кодами представления информации. Эта форма служит для формирования понятий и представлений, выявления смысла, содержания информации и ее обобщения.

Прагматическая (потребительская) адекватность. Она отражает отношение информации и ее потребителя, соответствие информации цели управления, которая на ее основе реализуется. Проявляются прагматические свойства информации только при наличии единства информации (объекта), пользователя и цели управления. Прагматический аспект рассмотрения связан с ценностью, полезностью использования информации при выработке потребителем решения для достижения своей цели. С этой точки зрения анализируются потребительские свойства информации. Эта форма адекватности непосредственно связана с практическим использованием информации, с соответствием ее целевой функции деятельности системы.

МЕРЫ ИНФОРМАЦИИ

Классификация мер

Для измерения информации вводятся два параметра: количество информации I и объем данных Vд.

Эти параметры имеют разные выражения и интерпретацию в зависимости от рассматриваемой формы адекватности. Каждой форме адекватности соответствует своя мера количества информации и объема данных (рис. 2.1).

Рис. 2.1. Меры информации

Синтаксическая мера информации

Эта мера количества информации оперирует с обезличенной информацией, не выражающей смыслового отношения к объекту.

в двоичной системе счисления единица измерения - бит (bit - binary digit - двоичный разряд);

Примечание. В современных ЭВМ наряду с минимальной единицей измерения данных "бит" широко используется укрупненная единица измерения "байт", равная 8 бит.

в десятичной системе счисления единица измерения -дит (десятичный разряд).

Количество информации - на синтаксическом уровне невозможно определить без рассмотрения понятия неопределенности состояния системы (энтропии системы). Действительно, получение информации о какой-либо системе всегда связано с изменением степени неосведомленности получателя о состоянии этой системы. Рассмотрим это понятие.

Пусть до получения информации потребитель имеет некоторые предварительные (априорные) сведения о системе a. Мерой его неосведомленности о системе является функция H(a), которая в то же время служит и мерой неопределенности состояния системы.

т.е. количество информации измеряется изменением (уменьшением) неопределенности состояния системы.

Если конечная неопределенность Hb(a) обратится в нуль, то первоначальное неполное знание заменится полным знанием и количество информации Ib(a)=H(a). Иными словами, энтропия системы H(a) может рассматриваться как мера недостающей информации.

Энтропия системы H(a), имеющая N возможных состояний, согласно формуле Шеннона, равна:

где Рi - вероятность того, что система находится в i-м состоянии.

Для случая, когда все состояния системы равновероятны, т.е. их вероятности равны Pi=1/N, ее энтропия определяется соотношением

Часто информация кодируется числовыми кодами в той или иной системе счисления, особенно это актуально при представлении информации в компьютере. Естественно, что одно и то же количество разрядов в разных системах счисления может передать разное число состояний отображаемого объекта, что можно представить в виде соотношения

N=m n ,

где N -число всевозможных отображаемых состояний;

т - основание системы счисления (разнообразие символов, применяемых в алфавите);

Наиболее часто используются двоичные и десятичные логарифмы. Единицами измерения в этих случаях будут соответственно бит и дит.

причем 0

С увеличением Y уменьшаются объемы работы по преобразованию информации (данных) в системе. Поэтому стремятся к повышению информативности, для чего разрабатываются специальные методы оптимального кодирования информации.

Семантическая мера информация

Тезаурус - это совокупность сведений, которыми располагает пользователь или система.

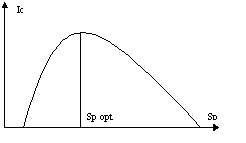

В зависимости от соотношений между смысловым содержанием информации S и тезаурусом пользователя Sp изменяется количество семантической информации Ic, воспринимаемой пользователем и включаемой им в дальнейшем в свой тезаурус. Характер такой зависимости показан на рис.2.2. Рассмотрим два предельных случая, когда количество семантической информации Ic равно 0:

при Sp 0 пользователь не воспринимает, не понимает поступающую информацию;

при Sp; пользователь все знает, н поступающая информация ему не нужна.

Рис. 2.2. Зависимость количества семантической информации. воспринимаемой потребителем, от его тезауруса Ic=f(Sp)

Максимальное количество семантической информации Ic потребитель приобретает при согласовании ее смыслового содержания S со своим тезаурусом Sp (Sp = Sp opt), когда поступающая информация понятна пользователю и несет ему ранее не известные (отсутствующие в его тезаурусе) сведения.

При оценке семантического (содержательного) аспекта информации необходимо стремиться к согласованию величин S и Sp.

Относительной мерой количества семантической информации может служить коэффициент содержательности С, который определяется как отношение количества семантической информации к ее объему:

Прагматическая мера информации

Эта мера определяет полезность информации (ценность) для достижения пользователем поставленной цели. Эта мера также величина относительная, обусловленная особенностями использования этой информации в той или иной системе. Ценность информации целесообразно измерять в тех же самых единицах (или близких к ним), в которых измеряется целевая функция.

Пример 2.5. В экономической системе прагматические свойства (ценность) информации можно определить приростом экономического эффекта функционирования, достигнутым благодаря использованию этой информации для управления системой:

Inb(g)=П(g /b)-П(g),

П(g) -априорный ожидаемый экономический эффект функционирования системы управления g,

Понятие "информация" имеет различные трактовки в разных предметных областях. Например, информация может пониматься как:

- абстракция, абстрактная модель рассматриваемой системы (в математике);

- сигналы для управления, приспособления рассматриваемой системы (в кибернетике);

- мера хаоса в рассматриваемой системе (в термодинамике);

- вероятность выбора в рассматриваемой системе (в теории вероятностей);

- мера разнообразия в рассматриваемой системе (в биологии) и др.

Рассмотрим это фундаментальное понятие информатики на основе понятия "алфавит" ("алфавитный", формальный подход). Дадим формальное определение алфавита .

Алфавит – конечное множество различных знаков, символов, для которых определена операция конкатенации (приписывания, присоединения символа к символу или цепочке символов); с ее помощью по определенным правилам соединения символов и слов можно получать слова (цепочки знаков) и словосочетания (цепочки слов ) в этом алфавите (над этим алфавитом ).

Буквой или знаком называется любой элемент x алфавита X , где . Понятие знака неразрывно связано с тем, что им обозначается ("со смыслом"), они вместе могут рассматриваться как пара элементов (x, y) , где x – сам знак, а y – обозначаемое этим знаком.

Пример. Примеры алфавитов : множество из десяти цифр, множество из знаков русского языка, точка и тире в азбуке Морзе и др. В алфавите цифр знак 5 связан с понятием "быть в количестве пяти элементов".

Конечная последовательность букв алфавита называется словом в алфавите (или над алфавитом ).

Длиной |p| некоторого слова p над алфавитом Х называется число составляющих его букв .

Слово (обозначаемое символом ) имеющее нулевую длину , называется пустым словом : | | = 0.

Множество различных слов над алфавитом X обозначим через S(X) и назовем словарным запасом (словарем) алфавита (над алфавитом ) X .

В отличие от конечного алфавита , словарный запас может быть и бесконечным.

В алфавите должен быть определен порядок следования букв (порядок типа "предыдущий элемент – последующий элемент"), то есть любой алфавит имеет упорядоченный вид X = 1, x2, …, xn> .

Таким образом, алфавит должен позволять решать задачу лексикографического (алфавитного) упорядочивания, или задачу расположения слов над этим алфавитом , в соответствии с порядком, определенным в алфавите (то есть по символам алфавита ).

Информация по отношению к источнику или приемнику бывает трех типов: входная, выходная и внутренняя.

Информация по отношению к конечному результату бывает исходная, промежуточная и результирующая.

Информация по ее изменчивости бывает постоянная, переменная и смешанная.

Информация по стадии ее использования бывает первичная и вторичная.

Информация по ее полноте бывает избыточная, достаточная и недостаточная.

Информация по доступу к ней бывает открытая и закрытая.

Есть и другие типы классификации информации .

Пример. В философском аспекте информация делится на мировоззренческую, эстетическую, религиозную, научную, бытовую, техническую, экономическую, технологическую.

Читайте также: