Энтропия как мера неопределенности выбора реферат

Обновлено: 07.07.2024

Основоположник теории информации Клод Шеннон определил информацию, как снятую неопределенность. Точнее сказать, получение информации - необходимое условие для снятия неопределенности. Неопределенность возникает в ситуации выбора. Задача, которая решается в ходе снятия неопределенности – уменьшение количества рассматриваемых вариантов (уменьшение разнообразия), и в итоге выбор одного соответствующего ситуации варианта из числа возможных. Снятие неопределенности дает возможность принимать обоснованные решения и действовать. В этом управляющая роль информации.

Ситуация максимальной неопределенности предполагает наличие нескольких равновероятных альтернатив (вариантов), т.е. ни один из вариантов не является более предпочтительным. Причем, чем больше равновероятных вариантов наблюдается, тем больше неопределенность, тем сложнее сделать однозначный выбор и тем больше информации требуется для этого получить. Для N вариантов эта ситуация описывается следующим распределением вероятностей: .

Минимальная неопределенность равна 0, т.е. эта ситуация полной определенности, означающая что выбор сделан, и вся необходимая информация получена. Распределение вероятностей для ситуации полной определенности выглядит так: .

Величина, характеризующая количество неопределенности в теории информации обозначается символом H и имеет название энтропия, точнее информационная энтропия.

Энтропия ( H ) – мера неопределенности, выраженная в битах. Так же энтропию можно рассматривать как меру равномерности распределения случайной величины.

На рисунке 8. показано поведение энтропии для случая двух альтернатив, при изменении соотношения их вероятностей ( p , (1- p )).

Максимального значения энтропия достигает в данном случае тогда, когда обе вероятности равны между собой и равны ½, нулевое значение энтропии соответствует случаям ( p 0=0, p 1=1) и ( p 0=1, p 1=0).

Количество информации I и энтропия H характеризуют одну и ту же ситуацию, но с качественно противоположенных сторон. I – это количество информации, которое требуется для снятия неопределенности H . По определению Леона Бриллюэна информация есть отрицательная энтропия (негэнтропия).

Когда неопределенность снята полностью, количество полученной информации I равно изначально существовавшей неопределенности H .

При частичном снятии неопределенности, полученное количество информации и оставшаяся неснятой неопределенность составляют в сумме исходную неопределенность. Ht + It = H .

По этой причине, формулы, которые будут представлены ниже для расчета энтропии H являются и формулами для расчета количества информации I , т.е. когда речь идет о полном снятии неопределенности, H в них может заменяться на I .

То, что событие случайно, означает отсутствие полной уверенности в его наступлении, что, в свою очередь, создает неопределенность в исходах опытов, связанных с данным событием. Безусловно, степень неопределенности различна для разных ситуаций. Например, если опыт состоит в определении возраста случайно выбранного студента 1-го курса дневного отделения вуза, то с большой долей уверенности можно утверждать, что он окажется менее 30 лет; хотя по положению на дневном отделении могут обучаться лица в возрасте до 35 лет, чаще всего очно учатся выпускники школ ближайших нескольких выпусков. Гораздо меньшую определенность имеет аналогичный опыт, если проверяется, будет ли возраст произвольно выбранного студента меньше 18 лет. Для практики важно иметь возможность произвести численную оценку неопределенности разных опытов. Попробуем ввести такую количественную меру неопределенности.

Начнем с простой ситуации, когда опыт имеет п равновероятных исходов. Очевидно, что неопределенность каждого из них зависит от n, т.е. мера неопределенности является функцией числа исходов f(n).

Можно указать некоторые свойства этой функции:

1. f(1) = 0, поскольку при п = 1 исход опыта не является случайным и, следовательно, неопределенность отсутствует;

2. f(n) возрастает с ростом п, поскольку чем больше число возможных исходов, тем более затруднительным становится предсказание результата опыта.

Для определения явного вида функции f(n) рассмотрим два независимых опыта α и β* с количествами равновероятных исходов, соответственно пα и пβ. Пусть имеет место сложный опыт, который состоит в одновременном выполнении опытов α и β; число возможных его исходов равно пα ∙ пβ, причем, все они равновероятны. Очевидно, неопределенность исхода такого сложного опыта α ^ β будет больше неопределенности опыта α, поскольку к ней добавляется неопределенность β; мера неопределенности сложного опыта равна f(nα ∙ nβ). С другой стороны, меры неопределенности отдельных α и β составляют, соответственно, f(nα) и f(nβ). В первом случае (сложный опыт) проявляется общая (суммарная) неопределенность совместных событий, во втором - неопределенность каждого из событий в отдельности. Однако из независимости α и β следует, что в сложном опыте они никак не могут повлиять друг на друга и, в частности, α не может оказать воздействия на неопределенность β, и наоборот. Следовательно, мера суммарной неопределенности должна быть равна сумме мер неопределенности каждого из опытов, т.е. мера неопределенности аддитивна:

* Для обозначения опытовсо случайными исходами будем использовать греческие буквы (α, β и т.д.), а для обозначения отдельных исходовопытов (событий) - латинские заглавные (А, В и т.д.).

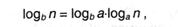

Теперь задумаемся о том, каким может быть явный вид функции f(n), чтобы он удовлетворял свойствам (1) и (2) и соотношению (2.1)? Легко увидеть, что такому набору свойств удовлетворяет функция log(n), причем можно доказать, что она единственная из всех существующих классов функций. Таким образом:

за меру неопределенности опыта с п равновероятными исходами можно принять число log(n).

Следует заметить, что выбор основания логарифма в данном случае значения не имеет, поскольку в силу известной формулы преобразования логарифма от одного основания к другому.

переход к другому основанию состоит во введении одинакового для обеих частей выражения (2.1) постоянного множителя logb а, что равносильно изменению масштаба (т.е. размера единицы) измерения неопределенности. Поскольку это так, имеется возможность выбрать удобное (из каких-то дополнительных соображений) основание логарифма. Таким удобным основанием оказывается 2, поскольку в этом случае за единицу измерения принимается неопределенность, содержащаяся в опыте, имеющем лишь два равновероятных исхода, которые можно обозначить, например, ИСТИНА (True) и ЛОЖЬ (False) и использовать для анализа таких событий аппарат математической логики.

Единица измерения неопределенности при двух возможных равновероятных исходах опыта называется бит*.

Таким образом, нами установлен явный вид функции, описывающей меру неопределенности опыта, имеющего п равновероятных исходов:

Эта величина получила название энтропия. В дальнейшем будем обозначать ее Н.

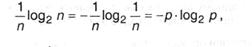

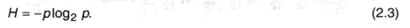

Вновь рассмотрим опыт с п равновероятными исходами. Поскольку каждый исход случаен, он вносит свой вклад в неопределенность всего опыта, но так как все п исходов равнозначны, разумно допустить, что и их неопределенности одинаковы. Из свойства аддитивности неопределенности, а также того, что согласно (2.2) общая неопределенность равна log2 п, следует, что неопределенность, вносимая одним исходом составляет

где р = - вероятность любого из отдельных исходов.

Таким образом, неопределенность, вносимая каждым из равновероятных исходов, равна:

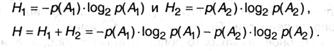

Теперь попробуем обобщить формулу (2.3) на ситуацию, когда исходы опытов неравновероятны, например, р(А1) и р(А2). Тогда:

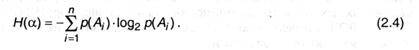

Обобщая это выражение на ситуацию, когда опыт α имеет п неравновероятных исходов А1, А2. Ап, получим:

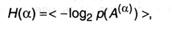

Введенная таким образом величина, как уже было сказано, называется энтропией опыта ос. Используя формулу для среднего значения дискретных случайных величин (А.11), можно записать:

А ( α ) - обозначает исходы, возможные в опыте α.

Энтропия является мерой неопределенности опыта, в котором проявляются случайные события, и равна средней неопределенности всех возможных его исходов.

Для практики формула (2.4) важна тем, что позволяет сравнить неопределенности различных опытов со случайными исходами.

Документ из архива "Энтропия", который расположен в категории " ". Всё это находится в предмете "химия" из раздела "", которые можно найти в файловом архиве Студент. Не смотря на прямую связь этого архива с Студент, его также можно найти и в других разделах. Архив можно найти в разделе "рефераты, доклады и презентации", в предмете "химия" в общих файлах.

Онлайн просмотр документа "Реферат Энтропия"

Текст из документа "Реферат Энтропия"

Статистический смысл понятия энтропии…………………………4-5

Энтропия как мера степени неопределенности……………………5-6

Понятие об информации.

Негативное влияние информации……………………………………..8

Энергоинформационная (квантово-механическая) мера……..11

Теорема Шеннона о кодировании при наличии помех……………. 11-12

Пример использования энтропии в прогнозировании.

Ее значение для прогнозирования………………………………..12-14

Применение к рискам…………………………………………. …14-15

Предмет работы: энтропия и информация.

Цель работы: изучение энтропии и информации, а так же: какое применение имеют данные понятия к рискам.

В ходе данной работы предстоит решить несколько задач: рассмотрение понятия энтропии и информации, статистического и термодинамического смысла энтропии, так же определение данного понятия, как меры степени неопределенности, теоремы Шеннона о кодировании при наличии помех, использования энтропии в прогнозировании и применения энтропии к рискам.

Данная тема является злободневной, так как широко пользуются в физике, химии, биологии и теории информации. Клаузиузус первым же в 1865 году положил начало применению понятия энтропия на основе анализа тепловых машин. Трудно найти определения более общие для всех наук (не только естественных), чем энтропия и информация. Возможно, это связано с самими названиями. С тех пор энтропия многократно фигурировала в знаменитых спорах. Например, в исторической науке энтропия имеет не малое значение для объяснения экспликации феномена вариативности истории.

Существующему давно понятию “информация” , был придан математически точный смысл К.Шенноном. Это как приводило, так и приводит ко многим недоразумениям, поэтому очень важно уделить данному понятию должное внимание. Никакая информация, никакое знание не появляется сразу - этому предшествует этап накопления, осмысления, систематизации опытных данных, взглядов. Информация является общим компонентом для всех наук, она связывает между собой различные по характеру и содержанию науки, поэтому информационные процессы, которые изучаются информатикой, имеют место во многих предметных областях.

Нельзя ограничивать информационные процессы рамками вычислений и пассивного получения или преобразования информации. Эти процессы сложны и многообразны. Важно научить новое поколение это понимать. Информация не всегда связана с компьютером. Чаще всего именно человек активно ее обрабатывает. Умение в процессе обработки не только анализировать, но и синтезировать из отдельных крупинок информации целое - весьма ценное качество человека будущего.

Я согласна с необходимостью изучения понятия энтропии, синергетики, социальной информатики, эволюции и т.п.

Статистический смысл понятия энтропии.

Вероятностное толкование понятия энтропии было дано в статистической физике Людвигом Больцманом. Введем для начала понятие термодинамической вероятности (W). Термодинамическая вероятность означает число возможных неотличимых микроскопических состояний системы реализующих определенное макроскопическое состояние этой системы.

Б удем рассматривать простую систему всего из двух неотличимых молекул, которые находятся в некотором объеме. Мысленно разделим этот объем на две части, и, пронумеровав молекулы, найдем число способов, которым можно разместить их в этих двух частях.

ы можем увидеть, что всего 4 способа, но два нижних неотличимы, так как молекулы 1 и 2 совершенно одинаковы, и соответствуют одному и тому же макроскопическому состоянию системы. Таким образом, мы имеем три различных макроскопических состояния системы, два из которых (верхних) , реализуемых только одним способом, а третье, нижнее двумя. Число способов-термодинамическая вероятность W. Все четыре способа равновероятны, поэтому большую часть времени система будет находиться в третьем состоянии.

Мы рассматривали только 2 молекулы. Число способов размещения n молекул в двух частях объема равно 2 n , а число способов размещения всех молекул в одной половине объема равно 1. Энтропия термодинамического состояния системы определяется через термодинамическую вероятность:

S = k·lnW, где k – постоянная Больцмана. Данное выражение называется принципом Больцмана [2].

В статистической термодинамике энтропия так же характеризует меру беспорядка и хаоса.

Энтропия как мера степени неопределенности.

Существование неопределённости связано с участием вероятностей в осуществлении событий. Устранение неопределённости есть увеличение вероятности наступления того, что задано как цель. Поэтому вероятности должны участвовать в математической формулировке величины устранённой неопределённости.

Первая удачная попытка реализовать определение информации на такой основе осуществлена в 1928 г. Л. Хартли. Пусть возможно в данных условиях n вариантов некоторого результата. Целью является один из них. Хартли предложил характеризовать неопределённость логарифмом числа n [1].

Количественная мера s полученной информации (устранённой неопределённости)выражается логарифмом отношения вероятностей:

Есть один недостаток-это определение справедливо только в приближении равновероятности всех исходов. Это выполняется далеко не всегда. В пределе в этом определении невероятному исходу приравнивается неизбежный. В 1948 г. это исправил К. Шеннон.

В качестве меры априорной неопределенности системы (или прерывной случайной величины ) в теории информации применяется специальная характеристика, называемая энтропией. Понятие об энтропии является в теории информации основным.

Энтропией системы называется сумма произведений вероятностей различных состояний системы на логарифмы этих вероятностей, взятая с обратным знаком:

. (18.2.2)

Энтропия обладает рядом свойств, которые оправдывают выбор данного понятия в качестве характеристики степени неопределенности. Во-первых, обращение энтропии в нуль объясняется достоверностью состояния системы при других-невозможных. Во-вторых, энтропия о бращается в максимум при равновероятности состояний, а при увеличении числа состояний - увеличивается. Главное: свойство аддитивности.

Энтропию дискретного опыта удобно находить как вес следующего графа:

Понятие об информации.

Понятие информации (informatio - разъяснение, осведомление, изложение) – это основное понятие не только в информатике (в информологии - области знаний, изучающей проявление информации, её представление, измерение и т.д.),но и в математике, в физике и др., плохо формализуется и структурируется. Из-за его объёмности, расплывчатости оно часто понимается неточно и неполно не только обучаемыми.

Информация может существовать в пассивной (не актуализированной) и активной (актуализированной) форме.

Информация по отношению к окружающей среде (или к использующей ее среде) бывает трех типов: входная, выходная и внутренняя.

Информация по отношению к конечному результату проблемы бывает: исходная (на начало актуализации этой информации); промежуточная (от начала до завершения актуализации информации); результирующая (после завершения её актуализации).

Информация по изменчивости при её актуализации бывает: постоянная (не изменяемая никогда при её актуализации); переменная (изменяемая при актуализации); смешанная - условно - постоянная (или условно-переменная).

Негативное влияние информации.

Информация может оказаться и вредной, влияющей негативно на сознание, например,воспитывающей восприятие мира от безразличного или же некритического - до негативного, "обозлённого", неадекватного. Информационный поток -достаточно сильный раздражитель.

Пример. Негативной информацией - раздражителем может быть информация о крахе коммерческого банка, о резком росте (спаде) валютного курса, об изменении налоговой политики и др. [5].

Пусть имеется N состояний системы S или N опытов с различными, равновозможными, последовательными состояниями системы. Наименьшее число, при котором это возможно, называется мерой разнообразия множества состояний системы и задается формулой Р. Хартли:

H=klogаN, где k - коэффициент пропорциональности (масштабирования, в зависимости от выбранной единицы измерения меры), а - основание системы меры. Если измерение ведется в экспоненциальной системе, то k=1, H=lnN (нат); если измерение было произведено в двоичной системе, то k=1/ln2, H=log2N (бит); если измерение было произведено в десятичной системе, то k=1/ln10, H=lgN (дит).

Пример. Чтобы узнать положение точки в системе из двух клеток т.е. получить некоторую информацию, необходимо задать 1 вопрос:

("Левая или правая клетка?").

Узнав положение точки, мы увеличиваем суммарную информацию о системе на 1 бит (I=log22). Для системы из четырех клеток необходимо задать 2 аналогичных вопроса, а информация равна 2 битам (I=log24). Если же система имеет n различных состояний, то

максимальное количество информации будет определяться по формуле: I=log2n.

Справедливо утверждение Хартли: если в некотором множестве X=

x2, . xn> необходимо выделить произвольный элемент xi X, то для того, чтобы выделить (найти) его, необходимо получить не менее logan (единиц) информации [4].

Шеннон вывел это определение энтропии из следующих предположений: мера должна быть непрерывной; т. е. изменение значения величины вероятности на малую величину должно вызывать малое результирующее изменение энтропии.

Шеннон показал, что любое определение энтропии, удовлетворяющее этим предположениям, должно быть в форме:

Предметом работы является энтропия и информация. Целью данной работы является изучение энтропии, информации и применения данных понятий к рискам. Поставленная цель ставит решение следующих задач: рассмотрения понятия энтропии, статистического смысла данного понятия, энтропии как меры степени неопределенности, понятия об информации, теоремы Шеннона о кодировании при наличии помех, использования энтропии в прогнозировании и применения энтропии к рискам.

Данная тема актуальна, так как трудно найти понятия более общие для всех наук (не только естественных) и, вместе с тем, иногда носящих оттенок загадочности, чем энтропия и информация. Отчасти это связано с самими названиями. Если бы не звучное название “энтропия” осталась бы с момента первого рождения всего лишь “интегралом Клаузиуса”, вряд ли она бы не рождалась вновь и вновь в разных областях науки под одним именем. Кроме того, ее первооткрыватель Клаузиузус, первым же положил начало применению введенного им для, казалось бы узкоспециальных термодинамических целей понятия к глобальным космологическим проблемам (тепловая смерть Вселенной). С тех пор энтропия многократно фигурировала в оставшихся навсегда знаменитыми спорах. В настоящее время универсальный характер этого понятия общепризнан и она плодотворно используется во многих областях.

Термин “информация” замечателен тем, что, существующему с давних пор бытовому понятию, К.Шенноном был придан математически точный смысл. Неопределенно-бытовой смысл этого термина уже научного. Это приводило и приводит ко многим недоразумениям/ Данную тему опишем с помощью следующих методов: синтеза, анализа, индукции, дедукции, сравнения и расчетного метода.

Работа изложена на 26 страниц и состоит из четырех параграфов. В работе 1 таблица и 7 примеров.

§1. Понятие энтропии. Статистический смысл понятия энтропии. Энтропия как мера степени неопределенности

Энтропия (от греч. entropia - поворот, превращение) - мера неупорядоченности больших систем. Впервые понятие "энтропия" введено в XIX в. в результате анализа работы тепловых машин, где энтропия характеризует ту часть энергии, которая рассеивается в пространстве, не совершая полезной работы (отсюда определение: энтропия - мера обесценивания энергии). Затем было установлено, что энтропия характеризует вероятность определенного состояния любой физической системы среди множества возможных ее состояний. В закрытых физических системах все самопроизвольные процессы направлены к достижению более вероятных состояний, т. е. к максимуму энтропии . В равновесном состоянии, когда этот максимум достигается, никакие направленные процессы невозможны. Отсюда возникла гипотеза о тепловой смерти Вселенной. Однако распространение на всю Вселенную законов, установленных для закрытых систем, не имеет убедительных научных оснований. В XX в. понятие " энтропия " оказалось плодотворным для исследования биосистем, а также процессов передачи и обработки информации. Эволюция в целом и развитие каждого организма происходит благодаря тому, что биосистемы, будучи открытыми, питаются энергией из окружающего мира. Но при этом биопроцессы протекают таким образом, что связанные с ними "производство энтропии " минимально. Это служит важным руководящим принципом и при разработке современных технологических процессов, при проектировании технических систем. Количественная мера информации формально совпадает с "отрицательно определенной " энтропией. Но глубокое понимание соответствия энтропии физической и информационной остается одной из кардинальных недостаточно исследованных проблем современной науки. Ее решение послужит одним из важных факторов становления нового научно-технического мышления.

Энтропия широко применяется и в других областях науки: в статистической физике как мера вероятности осуществления какого-либо макроскопического состояния; в теории информации как мера неопределенности какого-либо опыта (испытания), который может иметь разные исходы. Эти трактовки имеют глубокую внутреннюю связь. Например, на основе представлений об информационной энтропии можно вывести все важнейшие положения статистической физики.

В силу определения информации как устранённой неопределённости в достижении цели строгая (то есть математическая) формализация понятия об информации требует выразить математическим соотношением, что есть неопределённость в достижении цели.

Существование неопределённости связано с участием вероятностей в осуществлении событий. Устранение неопределённости есть увеличение вероятности наступления того, что задано как цель. Поэтому вероятности должны участвовать в математической формулировке величины устранённой неопределённости.

Первая удачная попытка реализовать определение информации на такой основе осуществлена в 1928 г. Л. Хартли. Пусть возможно в данных условиях n вариантов некоторого результата. Целью является один из них. Хартли предложил характеризовать неопределённость логарифмом числа n. То есть log n является количественной мерой неопределённости. Выбор основания логарифма связан с понятием об алфавитах для описания информации. Этот выбор существенен для экономичности кодирования в технических устройствах или живых системах (сокращения потоков импульсов или аналоговых сигналов), но не меняет самого количества информации как устранённой неопределённости за счёт того, что перед логарифмом вводится безразмерный множитель, выражаемый модулем перехода между основаниями логарифмов. От него зависят названия единиц информации.

Недостаток этого определения в том, что оно справедливо в приближении равновероятности всех исходов. Это выполняется далеко не всегда. В пределе в этом определении невероятному исходу приравнивается неизбежный. В 1948 г. это исправил К. Шеннон, который определил в качестве меры неопределённости выражение:

есть вероятности отдельных исходов. Он предложил называть эту величину "энтропией", не поясняя связей и различий этого термина с общеизвестой энтропией в физике. Знак минус в предыдущей формуле отражает тот факт, что вероятности всегда меньше единицы, а энтропия знакопостоянная функция, для которой привычно задан положительный знак. Определение Шеннона сокращённо зависывают в виде:

,

подразумевая как очевидное, что признаки (аргументы), по отношению к которым определены события и их вероятности, могут быть существенно разными, а в эта формула (суммирование в ней) справедлива только для однородных признаков.

§2. Понятие об информации. Измерение информации

Понятие информации (informatio - разъяснение, осведомление, изложение) является одним из основных, ключевых понятий не только в информатике (в информологии - области знаний, изучающей проявление информации, её представление, измерение и т.д.), но и в математике, в физике и др. Понятие “информация” - плохо формализуемое и структурируемое понятие. В силу его всеобщности, объёмности, расплывчатости оно часто понимается неточно и неполно не только обучаемыми. Как правило, это понятие в курсе информатики не определяется, принимается как исходное базовое понятие, неопределяемый терм.

Информация трактуется по разному, например, как:

• любая сущность, которая вызывает изменения в некоторой информационно-логической (инфологической - состоящей из данных, знаний, абстракций и т.д.) модели системы (математика, системный анализ);

• отрицание энтропии, отражение меры хаоса в системе (термодинамика);

• связи, устраняющие неопределённость в системе (теория информации);

• вероятность выбора в системе (теория вероятностей);

• отражение разнообразия в системе (физиология, биокибернетика);

• отражение материи, атрибут сознания, “интеллекта” системы (философия).

Но существует более полное понятие. Информация - это некоторая последовательность (налицо упорядоченность) сведений, знаний, которые актуализируемы (получаемы, передаваемы, преобразуемы, сжимаемы или регистрируемы) с помощью некоторых знаков (символьного, образного, жестового, звукового, сенсомоторного типа). Это приращение, развитие, актуализация знаний, возникающее в процессе целеполагающей интеллектуальной деятельности человека. Никакая информация, никакое знание не появляется сразу - этому предшествует этап накопления, осмысления, систематизации опытных данных, взглядов. Знание - продукт такого процесса. Мышление - необходимый атрибут такого процесса.

Информация может существовать в пассивной (не актуализированной) и активной (актуализированной) форме.

Информация в философском аспекте бывает, в основном: мировоззренческая; эстетическая; религиозная; научная; бытовая; техническая; экономическая; технологическая.

Все это (с человеком) составляет ноосферу общества - более высокое состояние биосферы, возникшее в результате эволюции, структурирования, упорядочивания и гармонизации связей в природе и обществе под воздействием целеполагающей деятельности человечества. Это понятие введено впервые В. И. Вернадским в качестве отражения эволюции общества и природы т.е. системы, в рамках которой потенциально может быть реализовано гармоническое, устойчивое развитие (эволюция) систем “Общество” и “Природа”, а также постепенное слияние, интеграция и гармонизация наук о природе, познании и об обществе. Без этого невозможно построение информационного общества.

Информация может оказаться и вредной, влияющей негативно на сознание, например, воспитывающей восприятие мира от безразличного или же некритического - до негативного, "обозлённого", неадекватного. Информационный поток - достаточно сильный раздражитель.

Пример. Негативной информацией - раздражителем может быть информация о крахе коммерческого банка, о резком росте (спаде) валютного курса, об изменении налоговой политики и др.

Информация не существует без других типов ресурсов - энергии, вещества, организации, как и они не могут существовать без информации. Любые взаимодействия систем (подсистем) - взаимодействия всегда материальноэнерго-информационные. Выявление (структурирование, упорядочивание, установление отношений), формализация (описание формальными средствами, языками), изучение (разработка моделей, методов, алгоритмов), применение (разработка и актуализация технологий) этих взаимодействий и составляет основную задачу информатики - как науки, как человеческой деятельности.

Информация может пониматься и интерпретироваться по разному. Вследствие этого имеются различные подходы к определению методов измерения информации, меры количества информации. Раздел информатики (теории информации) изучающий методы измерения информации называется информметрией.

Количество информации - числовая величина, адекватно характеризующая актуализируемую информацию по разнообразию, сложности, структурированности, определённости, выбору (вероятности) состояний отображаемой системы.

Если рассматривается система, которая может принимать одно из n возможных состояний, то актуальна задача оценки такого выбора, исхода. Такой оценкой может стать мера информации (или события). Мера - это некоторая непрерывная действительная неотрицательная функция, определённая на множестве событий и являющаяся аддитивной т.е. мера конечного объединения событий (множеств) равна сумме мер каждого события.

1. Мера Р. Хартли. Пусть имеется N состояний системы S или N опытов с различными, равновозможными последовательными состояниями системы. Если каждое состояние системы закодировать, например, двоичными кодами определённой длины d, то эту длину необходимо выбрать так, чтобы число всех различных комбинаций было бы не меньше, чем N. Наименьшее число, при котором это возможно или мера разнообразия множества состояний системы задаётся формулой Р. Хартли: H=k log а N, где k - коэффициент пропорциональности (масштабирования, в зависимости от выбранной единицы измерения меры), а - основание системы меры.

Если измерение ведётся в экспоненциальной системе, то k=1, H=lnN (нат); если измерение - в двоичной системе, то k=1/ln2, H=log2N (бит); если измерение - в десятичной системе, то k=1/ln10, H=lgN (дит).

Пример. Чтобы узнать положение точки в системе из двух клеток т.е. получить некоторую информацию, необходимо задать 1 вопрос ("Левая или правая клетка?"). Узнав положение точки, мы увеличиваем суммарную информацию о системе на 1 бит (I=log2 2). Для системы из четырех клеток необходимо задать 2 аналогичных вопроса, а информация равна 2 битам (I=log24). Если система имеет n различных состояний, то максимальное количество информации равно I=log2 n.

По Хартли, для того, чтобы мера информации имела практическую ценность - она должна быть такова, чтобы отражала количество информации пропорционально числу выборов.

Пример. Имеются 192 монеты из которых одна фальшивая. Определим сколько взвешиваний нужно произвести, чтобы определить ее. Если положить на весы равное количество монет, то получим 2 возможности (мы сейчас отвлекаемся от того, что в случае фальшивой монеты таких состояний будет два - состояния независимы): а) левая чашка ниже; б) правая чашка ниже. Таким образом, каждое взвешивание дает количество информации I=log22=1 и, следовательно, для определения фальшивой монеты нужно сделать не менее k взвешиваний, где k удовлетворяет условию log22k³ log2

Читайте также: