Три закона робототехники айзека азимова кратко и понятно

Обновлено: 05.07.2024

В рассказе "Хоровод", выпущенном в рамках цикла фантастических произведений "Я, робот" в 1942 году Айзек Азимов для своего вымышленного мира создал свод правил, коим должен был следовать каждый робот при взаимодействии с человеком – законы робототехники. Несмотря на свою фантазийную природу, многие и сегодня склоняются к тому, что данные ограничения можно было бы использовать и в реальной жизни, распространяя их на мыслящие роботизированные механизмы.

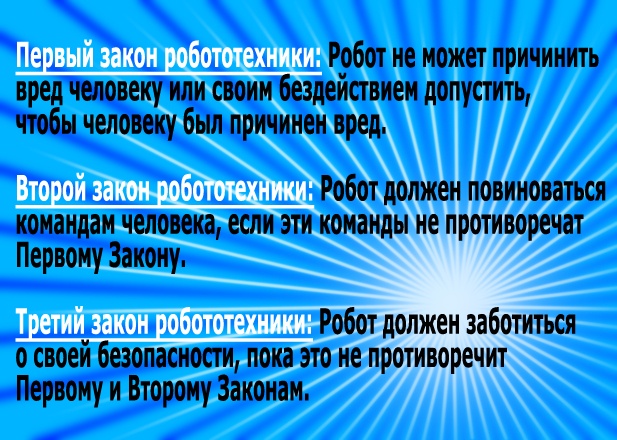

В сущности, три закона робототехники выглядят следующим образом:

- Робот не должен наносить какой-либо вред человеческому здоровью, создавать угрозу жизни или своим бездействием допускать аналогичные последствия;

- Роботу вменяется в обязательном порядке исполнять приказы, отдаваемые человеком. Единственное исключение – отдаваемый приказ не должен противоречить предыдущему положению;

- Роботу вменяется беспокоиться о собственной безопасности в той степени и в том объеме, в которых его действия не опровергают два предыдущих пункта.

Вышеперечисленные законы робототехники Азимова в рассказах внедрялись непосредственно в ПО и надежно защищены от пересмотра и переписывания. Хотя несовершенство данного свода стало явным практически сразу – лазейки, неточности и неясности довольно часто приводили к нелогичному и неправильному поведению роботов. Этому способствовал целый ряд причин, среди которых неточная, расплывчатая формулировка и сложность в нахождении различий между "людьми" и "роботами". Однако самым распространенным обстоятельством, ввиду коего нарушались 3 закона робототехники, были неосознанные действия машин и попытки чрезмерно изворотливых роботов или ИИ перепрограммировать собственное ядро.

Несмотря на свою историю длительностью в много десятков лет, эта тематика остается актуальной и по сей день. Многое из того, что еще пару десятков лет назад было немыслимым, становится потенциально или даже явно возможным. К слову, мир, описанный Айзеком Азимовым, с некоторыми оговорками удивительно напоминает сегодняшний. При этом, согласно заявлениям создателя, написанные законы робототехники вполне могли бы быть применены и в реальной жизни. В интервью журналу Compute! 1981 году он отмечал: "Когда у меня спрашивали, возможно ли использование данных законов в самом деле, ответ был ясен заранее. Однако для этого требуется, чтобы роботы были в надлежащей мере разносторонними и универсальными, чтобы быть способными на различные схемы поведения".

К сожалению, оптимизм всемирно известного фантаста многие ученые не разделяют. Так, три закона робототехники тщательно изучали и анализировали два теоретика ИИ: Бен Герцель (Аидия Холдингс) и Луи Хельм (Институт MIRI). И они совершенно уверены, что положения наверняка не осилят препорученную миссию. Согласно их докладу, Айзека Азимова законы робототехники имеют три ключевых недостатка:

- обладают состязательной сущностью;

- базируются на неактуальной сегодня этической теории (деонтологии);

- удивительно, но и во вселенной фантаста роботы не способны надлежаще реализовывать собственное предназначение.

Несмотря на все свои изъяны, законы робототехники Азимова стали первой честной попыткой охватить огромную технологическую сферу, положив начало долгому пути поисков и исследований. К примеру, не так давно Google опубликовал свое видение безопасного ИИ, сформулировав свои пять законов робототехнических механизмов.

Подробнее ознакомиться с учебным оборудованием по робототехнике вы можете на нашем сайте.

Три закона робототехники Айзека Азимова, вероятно, являются самыми известными и влиятельными из когда-либо написанных в сайенс-фикшн строк в направлении технической политики. Известный писатель предположил, что по мере того, как машины будут обретать большую автономию и играть большую роль в жизни человека, нам понадобятся жёсткие правила, чтобы они не могли нанести нам вред.

Теперь, с A.I., автоматизацией и восходом заводской робототехники создаваемые машинами и их производителями опасности ещё более сложны и насущны. Специально к старту нового потока курса Machine Learning представляем вам перевод интервью с Фрэнком Паскуале, профессором Бруклинского юридического института, который в провокационной книге New Laws of Robotics: Defending Human Expertise in the Age of AI предлагает добавить четыре новых закона к трём законам Азимова.

Приводим законы Азимова для тех, кто с ними не знаком:

- Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинён вред.

- Робот должен повиноваться всем приказам, которые даёт человек, кроме тех случаев, когда эти приказы противоречат первому закону.

- Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит первому или второму законам.

- Цифровые технологии должны дополнять профессионалов, а не заменять их.

- ИИ и роботизированные системы не должны подделывать человека.

- В области ИИ следует предотвратить усиление гонок вооружения с нулевой суммой [прим. перев. — это относится к понятию игр с нулевой суммой из теории игр].

- Роботы и системы ИИ должны указывать на личность своих создателей, контролирующих их людей и владельцев.

OneZero обратился к Паскуале, чтобы обсудить, почему он решил обновить законы Азимова, поговорить о причинах, лежащих в основе новых законов, и о многом другом.

Почему вы считаете важным обновить три закона Азимова? Кроме того, зачем делать акцент в книге вокруг демократизации этих решений о том, как используются робототехника и искусственный интеллект?

Законы Азимова — о том, чтобы роботы не обращались с людьми плохо. И я думаю, что это очень важно, конечно, но нам нужно больше идей, учитывающих настоящее и будущее, с которым мы столкнёмся. Намного больше. Нам необходимо обеспечить прочный и демократичный человеческий контроль над развитием технологий. Я думаю, большая мечта многих людей из области ИИ, предположительно, — просто позволить ИИ взять на себя работу врача, медсестры, журналиста, учителя и так далее. И моя идея заключается в том, что это в действительности не та цель, к которой мы должны стремиться. Верно? Главный вопрос — в том, должны ли мы вообще делать так. Думаю, нет. Надлежащая роль многих из этих технологических областей для меня — дополнять и поддерживать профессионалов, а не заменять их.

Вполне вероятно, что дискуссии вокруг А.I. можно переосмыслить таким образом и отойти от мысли, что роботы заберут у нас нашу работу?

Каковы ваши размышления о том, что стоит за каждым новым законом робототехники?

Видение этого очень широко. Будь моя воля, широта задач была бы сопоставима с чем-то вроде Нового курса, где, в сущности, имелся бы массив укоренявшихся десятилетиями агентств с законодательными уставами объёмом от пяти до ста или около того страниц. Затем возникли бы агентства, похожие на Агентство безопасности, Комиссию по ценным бумагам, Федеральную комиссию связи и другие, работающие над уточнением вышеупомянутых уставов. Я надеюсь, что это произойдёт с приходом новых законов робототехники, что придут независимые агентства, которые будут уполномочены применять эти идеи.

Можете привести пару конкретных примеров того, как некоторые из ваших законов будут работать на практике?

Конечно. Возьмите первый предложенный закон о профессиях и дополнении ИИ. Робот не должен быть сертифицирован как учитель. Можно разрешить роботов или ИИ в качестве технологии, которую учителя смогут прописывать точно так же, как врачи прописывают лекарства, но не нужно стремиться к тому, чтобы учителя или какое-либо сочетание онлайн-лекций отслеживалось и курировалось исключительно искусственным интеллектом. Не хочется, чтобы ИИ действительно заменил учителей. Это пример работы закона о комплементарности в работе.

Ваш третий новый закон направлен на предотвращение усиления гонки вооружений. Он не ограничивается военными вопросами, верно?

Не могли бы вы пояснить закон о том, что ИИ и робототехника должны направлять к своим создателям? Почему это так важно?

Закон вводится, по сути, для того, чтобы остановить даже идею или стремление ИИ быть автономным от людей. Я имею в виду, что существуют научно-фантастические или футуристические устремления к созданию роботов, которые могли бы быть похожими, скажем, на ваших детей. Мы обучали бы их, пока они молоды, а потом отправляли в мир. Представьте себе робота в фильме Ex Machina, Ava, её просто неконтролируемый выход в мир и так далее. Такого не должно случиться никогда. Любой выпущенный в мир робот или любой участвующий в сети как бот ИИ — все они должны отслеживаться до их владельца или контролёра, который может в любой момент отключить их или иным образом изменить их поведение, то есть робот не должен быть автономным. Мы просто избавляемся от идеи автономности. Вычёркиваем ее как то, чего никогда не сделаем.

Какая ответственность лежит на создателях за то, что в итоге делают роботы и ИИ?

Для занятых в областях робототехники и искусственного интеллекта людей пришло время взять ответственность за невероятную гибкость и пластичность их ПО, которое можно было бы запрограммировать иначе. Возьмём такой пример: я не должен расстраиваться или сочувствовать плачущему роботу, потому что его можно так же легко запрограммировать смеяться над всем, что заставляет его искусственно плакать. И здесь мы должны быть трезвыми, поскольку существует быстрорастущая область аффективных вычислений, которая для меня во многих отношениях — прелюдия к манипулированию людьми и контролю над ними со стороны крупных корпораций и правительств через посреднические эффекты технологий. И мы должны смотреть этим мрачным возможностям прямо в глаза.

В вашей предыдущей книге The Black Box Society: The Secret Algorithms That Control Money and Information вы скрупулёзно изучаете, как подобные YouTube или Facebook-платформы процветают с помощью алгоритмов, задерживающих нас на сайте через предложение контента, в значительной степени основанного на том, что мы уже посмотрели. И, как мы все уже видели, это часто заканчивается поощрением и распространением дезинформации и теорий заговора. На ваш взгляд, нужно ли больше регулирования для решения этой проблемы?

Что, по-вашему, заставляет нас хотеть создавать роботов и ИИ, которые очень похожи на нас?

В чем конкретно эти позиции антигуманнны?

В целом что больше всего мотивировало на конфронтацию с возникающим ИИ в книге?

Три Закона робототехники – основополагающие ограничительные правила алгоритма действий робота, сформулированные американским фантастом Айзеком Азимовым .

По признанию самого писателя, он всегда полагал, что робот – это всего лишь очередной вид машин , созданных человеком. Любая машина несет в себе какую-то опасность , для защиты от которой люди разрабатывают специальные предохранительные устройства .

В 1939 году Азимов начал писать цикл рассказов, в которых главные действующие персонажи – металлические антропоморфные механизмы , снабженные позитронным мозгом.

Закон номер Один . Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинен вред.

Закон номер Два . Робот должен повиноваться всем приказам, которые дает человек, если эти приказы не противоречат Первому Закону.

Закон номер Три . Робот должен заботиться о своей безопасности в той мере, в какой это не противоречит Первому и Второму Законам.

Законы робототехники приобрели невероятную популярность у читателей и стали казаться столь значительными, что их начали заимствовать другие писатели-фантасты для своих произведений.

Законы робототехники – своего рода Заповеди Азимова для потомков, которые будут работать над созданием Искусственного Интеллекта .

Первый закон робототехники. Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинен вред.

Второй закон робототехники. Робот должен повиноваться командам человека, если эти команды не противоречат Первому Закону.

Известные произведения фантаста

Биография А.Азимова

Азимов родился (по документам) 2 января 1920 года в Петровичах, Горецкого уезда Могилёвской губернии, в России (в действительности он мог родиться и несколько раньше, вплоть до 19 октября 1919 года). Его родители, Анна Рахиль Берман-Азимова (Anna Rachel Berman Asimov) (1895—1973) и Иегуда Азимов (Judah Asimov) (1896—1969), были евреями по национальности и мельниками по профессии. Назвали его в честь покойного деда по матери, Исаака Бермана.

У Азимова была младшая сестра Марция (Marcia, род. 1922; до переезда в США её звали Маня) и младший брат Стэнли (Stanley, 1929—1995). Впоследствии Марция вышла замуж (1955) и родила двоих сыновей. Стэнли стал журналистом и сделал успешную карьеру в ежедневной газете Newsday. Его должность называлась vice president in charge of editorial administration. Умер Стэнли от лейкемии 16 августа 1995 года. У Стэнли было трое детей: Эрик (Eric) и Нэнит (Nanette), оба журналисты, и Дэниел (Daniel), математик. Дэниела Азимова можно найти в Сети, но он не любит, когда к нему пристают с вопросами о его знаменитом дяде.

В 1923 родители увезли его в США, где поселились в Бруклине и через несколько лет открыли кондитерский магазин. Поскольку Азимов уехал из России в трёхлетнем возрасте, а родители, будучи в США, старались говорить с ним только по-английски, он почти не знал русского языка.

В 5 лет Айзек Азимов пошёл в школу. (Ему полагалось пойти в школу 6 лет, но мать исправила его день рождения на 7 сентября 1919 года, чтобы отдать его в школу на год раньше.) После окончания десятого класса в 1935 году, 15-летний Азимов поступил в Seth Low Junior College, но через год этот колледж закрылся. Азимов поступил на химический факультет Колумбийского университета в Нью-Йорке, где получил в 1939 году степень бакалавра (B. S.), а в 1941 году — магистра (M. Sc.) по химии и поступил в аспирантуру. Однако в 1942 году он уехал в Филадельфию, чтобы работать химиком на Филадельфийской судоверфи для армии. Вместе с ним там же работал и другой писатель-фантаст Роберт Хайнлайн.

С октября 1945 года по июль 1946 Азимов служил в армии. Затем вернулся в Нью-Йорк и продолжил образование. В 1948 году закончил аспирантуру, получил степень Ph. D., соответствующую кандидату наук, и поступил в постдокторат как биохимик. В 1949 году он устроился преподавателем на медицинский факультет Бостонского Университета, где в декабре 1951 года стал ассистентом (assistant professor), а в 1955 году — ассоциированным профессором (associated professor). В 1958 году университет перестал ему платить зарплату, но формально оставил в прежней должности. К этому моменту доходы Азимова как писателя уже превышали его университетскую зарплату. В 1979 году ему было присвоено звание полного профессора (full professor).

В 1970 году Азимов расстался с женой и почти немедленно стал жить с Джанет Опал Джеппсон (Janet Opal Jeppson), с которой познакомился на банкете 1 мая 1959 года. (До этого они встречались в 1956 году, когда он подписал ей автограф. Азимов вообще не запомнил ту встречу, а Джеппсон сочла его неприятным человеком.) Развод вступил в силу 16 ноября 1973 года, а 30 ноября Азимов и Джеппсон поженились. От этого брака не было детей.

Умер 6 мая 1992 года от СПИДа, которым заразился при операции на сердце в 1983. О том, что причиной смерти был СПИД, стало известно лишь через 10 лет из биографии, написаной Джанет Опал Джеппсон.

Литературная деятельность Айзека Азимова

Писать Азимов начал в 11 лет. Он начал писать книгу о приключениях мальчиков, живущих в маленьком городке. Он написал 8 глав, после чего забросил книгу. Но при этом произошёл интересный случай. Написав 2 главы, Айзек пересказал их своему другу. Тот потребовал продолжение. Когда Айзек объяснил, что это пока всё, что он написал, его друг попросил дать почитать книгу, где Айзек прочёл эту историю. С того момента Айзек понял, что он обладает писательским даром, и стал серьёзно относиться к своей литературной деятельности.

Мы постарались быстро и просто ответить на вопрос: что такое законы робототехники? Остались вопросы? Обсужадйте их на форуме робототехников !

Первый Закон Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинен вред. Второй закон Робот должен подчиняться приказам людей, за исключением случаев, когда такие приказы противоречат Первому закону. Третий закон Робот должен защищать свое существование до тех пор, пока такая защита не противоречит Первому или Второму закону. [1]

Они образуют организующий принцип и объединяющую тему для Азимова. робот-основанная фантастика, появляющаяся в его Робот серии, истории, связанные с ним, и его Лаки Старр серии из художественная литература для молодежи. Законы включены почти во все позитронные роботы появляется в его художественной литературе и не может быть проигнорирован, поскольку предназначен для обеспечения безопасности. Во многих рассказах Азимова, посвященных роботам, роботы ведут себя необычным и нелогичным образом, что является непреднамеренным следствием того, как робот применяет три закона к ситуации, в которой он находится. Другие авторы, работающие во вселенной Азимова, заимствовали их и ссылки, часто пародийный, появляются как в научной фантастике, так и в других жанрах.

Первоначальные законы были изменены и доработаны Азимовым и другими авторами. Сам Азимов внес небольшие изменения в первые три в различных книгах и рассказах, чтобы в дальнейшем развить то, как роботы будут взаимодействовать с людьми и друг с другом. В более поздних произведениях, где роботы взяли на себя ответственность за управление целыми планетами и человеческими цивилизациями, Азимов также добавил четвертый, или нулевой, закон, предшествующий остальным:

Нулевой закон Робот не может причинить вред человечеству или своим бездействием позволить человечеству причинить вред.

Три закона и ноль стали неотъемлемой частью научной фантастики и упоминаются во многих книгах, фильмах и других средствах массовой информации. Они повлияли на мысли этика искусственного интеллекта также.

Содержание

История

В Остальные роботы, опубликованном в 1964 году, Исаак Азимов отметил, что, когда он начал писать в 1940 году, он чувствовал, что «одним из основных сюжетов научной фантастики было . роботы были созданы и уничтожены их создателем. Знание имеет свои опасности, да, но это ответ быть отступлением от знания? Или знание должно использоваться как преграда для тех опасностей, которые оно несет? " Он решил, что в своих рассказах робот не будет «тупо нападать на своего создателя без всякой цели, но чтобы продемонстрировать еще один утомительный раз, преступление и наказание. Фауст." [2]

В его рассказе "Доказательства" Азимов позволяет своему повторяющемуся персонажу Д-р Сьюзен Кэлвин изложить моральный основа трех законов. Кальвин отмечает, что от людей обычно ожидается воздержание от причинения вреда другим людям (кроме случаев крайнего принуждения, например войны, или для спасения большего числа людей), и это эквивалентно Первому закону робота. Точно так же, согласно Кальвину, общество ожидает, что люди будут подчиняться инструкциям признанных авторитетов, таких как врачи, учителя и т. Д., Что равносильно второму закону робототехники. Наконец, ожидается, что люди будут избегать нанесения вреда себе, что является третьим законом для роботов.

- Правило 1. Инструмент не должен быть небезопасным. Молотки иметь ручки и отвертки иметь рукоятки для увеличения сцепления. Конечно, человек может пораниться одним из этих инструментов, но эта травма будет вызвана только его некомпетентностью, а не конструкцией инструмента.

- Правило 2: Инструмент должен выполнять свою функцию эффективно, если это не может нанести вред пользователю. Это вся причина прерыватели цепи замыкания на землю существует. Любой работающий инструмент будет отключен, если цепь обнаружит, что некоторый ток не возвращается к нейтральному проводу и, следовательно, может протекать через пользователя. Безопасность пользователя превыше всего.

- Правило 3: Инструмент должен оставаться неповрежденным во время использования, если его уничтожение не требуется для его использования или для безопасности. Например, Дремель диски спроектированы таким образом, чтобы быть максимально прочными и не ломаться, если только работа не требует затрат. Кроме того, они предназначены для разрушения в точке, прежде чем скорость осколка может серьезно поранить кого-либо (кроме глаз, хотя в любом случае следует носить защитные очки).

Азимов считал, что в идеале люди также будут следовать законам: [13]

Переделки

Азимов

Первый закон изменен

1. Робот не может причинить вред человеку.

Гайя это планета с коллективный разум в Фонд серии который принимает закон, подобный Первому закону, и нулевому закону в качестве своей философии:

Гайя не может причинить вред жизни или позволить жизни причинить вред.

Добавлен нулевой закон

В финальных сценах романа Роботы и Империя, Р. Жискард Ревентлов является первым роботом, который действует согласно нулевому закону. Жискар телепатический, как робот Херби в рассказе "Лжец!", и пытается применить нулевой закон через свое понимание более тонкой концепции" вреда ", чем может постичь большинство роботов. [17] Однако, в отличие от Герби, Жискар понимает философскую концепцию Нулевого Закона, позволяющую ему причинять вред отдельным людям, если он может делать это на службе абстрактной концепции человечества. Нулевой закон никогда не запрограммирован в мозгу Жискара, но вместо этого является правилом, которое он пытается понять с помощью чистого метапознание. Хотя он терпит неудачу - это в конечном итоге разрушает его позитронный мозг, поскольку он не уверен, окажется ли его выбор на пользу человечеству или нет - он дает своему преемнику Р. Дэнилу Оливу свои телепатические способности. На протяжении многих тысяч лет Даниил приспосабливается к тому, чтобы полностью подчиняться Нулевому Закону. Как формулирует Дэниел, в романах Фонд и Земля и Прелюдия к основанию, Нулевой закон гласит:

Робот не может причинить вред человечеству или своим бездействием позволить человечеству причинить вред.

К первоначальным Трем законам было добавлено условие, гласящее, что Нулевой закон не должен нарушаться, хотя Азимов осознавал трудности, которые такой закон может создать на практике. Роман Азимова Фонд и Земля содержит следующий отрывок:

Переводчик включил концепцию нулевого закона в один из романов Азимова до того, как сам Азимов разъяснил закон. [18] Ближе к кульминации Пещеры из стали, Элайджа Бейли делает горький комментарий себе, думая, что Первый закон запрещает роботу причинять вред человеку. Он определяет, что так и должно быть, если робот недостаточно умен, чтобы понять, что его действия служат на благо человечества в долгосрочной перспективе. В картине Жака Брекара 1956 г. Французский перевод под названием Les Cavernes d'acier Мысли Бейли возникают несколько иначе:

Робот не может причинить вред человеку, если он не найдет способ доказать, что в конечном итоге нанесенный вред принесет пользу человечеству в целом! [18]

Отмена трех законов

За свою писательскую карьеру Азимов трижды изображал роботов, которые полностью игнорируют Три закона. Первый случай был краткий рассказ под названием "Первый Закон"и часто считается незначительной" сказкой " [19] или даже апокрифический. [20] С другой стороны, рассказ "Cal"(из коллекции Золото), рассказанный рассказчиком-роботом от первого лица, изображает робота, который игнорирует Три закона, потому что он обнаружил нечто гораздо более важное - он хочет быть писателем. Юмористический, отчасти автобиографичный и необычно экспериментальный по стилю "Кэл" считался одним из Золото'самые сильные истории. [21] Третий - это рассказ под названием "Салли"в которых автомобили, оснащенные позитронным мозгом, очевидно, способны причинять вред и убивать людей, игнорируя Первый закон. Однако, за исключением концепции позитронного мозга, эта история не относится к другим историям о роботах и, возможно, не будет происходить в том же самом непрерывность.

Персонажи рассказов часто указывают на то, что Три закона, существующие в сознании робота, - это не письменные версии, обычно цитируемые людьми, а абстрактные математические концепции, на которых основано все развивающееся сознание робота. Эта концепция в значительной степени расплывчата и неясна в более ранних историях, изображающих очень рудиментарных роботов, которые запрограммированы только на понимание основных физических задач, где Три закона действуют как всеобъемлющая защита, но к эпохе Пещеры из стали Используя роботов с человеческим или сверхчеловеческим интеллектом, Три закона стали основным этическим мировоззрением, определяющим действия всех роботов.

Другие авторы

Роджер Макбрайд Трилогия Аллена

Джек Уильямсон "Со скрещенными руками"

Фонд продолжение трилогии

В официально лицензированном Фонд сиквелы Страх Фонда, Основание и Хаос и Триумф Фонда (от Грегори Бенфорд, Грег Медведь и Дэвид Брин соответственно) будущее Галактическая Империя считается контролируемым заговором человекоподобных роботов, которые следуют Нулевому Закону и возглавляются Р. Дэниел Оливо.

Дэниел также вступает в конфликт с роботом, известным как Р. Лодович Трема, чей позитронный мозг был заражен мошенником. AI - в частности, симуляция давно умерших Вольтер - что, следовательно, освобождает Trema от Трех Законов. Трема приходит к убеждению, что человечество должно иметь право выбирать свое будущее. Более того, небольшая группа роботов утверждает, что сам Нулевой закон робототехники подразумевает более высокий закон робототехники минус один:

Робот не может навредить разумность или своим бездействием позволить разуму причинить вред.

Поэтому они заявляют, что для Дэнила безжалостно приносить в жертву роботов и внеземной разумная жизнь на благо человечества. Ни одна из этих интерпретаций не может успешно заменить нулевой закон Дэниела, хотя Триумф Фонда намекает, что эти роботизированные фракции остаются активными как маргинальные группы до времени романа Фонд. [27]

Действие этих романов происходит в будущем, продиктованном Азимовым свободным от очевидного присутствия роботов, и предполагается, что тайное влияние Р. Дэнила на историю на протяжении тысячелетий предотвратило повторное открытие позитронный мозг технологии и возможность работать на сложных интеллектуальных машинах. Это отсутствие повторного открытия и отсутствие возможностей гарантирует, что превосходящая физическая и интеллектуальная сила, которой обладают интеллектуальные машины, остается в полной собственности роботов, подчиняющихся той или иной форме Трех Законов. [27] То, что Р. Дэнилу не совсем удается в этом, становится ясно за короткий период, когда ученые Трантор развиваться "тиктокс"- упрощенные программируемые машины, похожие на реальных современных роботов и, следовательно, лишенные Трех Законов. Заговорщики роботов рассматривают транторианские тиктоки как огромную угрозу социальной стабильности, и их план по устранению угрозы тиктоков составляет большую часть сюжета Страх Фонда.

В Триумф Фонда различные фракции роботов интерпретируют Законы по-разному, по-видимому, обращая внимание на все возможные варианты неоднозначности Трех Законов.

Робот Тайна серии

Нельзя пренебрегать собственными творениями Азимова в этих областях, такими как солярианская технология "просмотра" и машины Неизбежный конфликт оригиналы, признанные Тидеманном. Аврора, например, машины называются "действительно первыми РУ". В дополнение Робот Тайна серия обращается к проблеме нанотехнологии: [29] Построение позитронного мозга, способного воспроизводить когнитивные процессы человека, требует высокой степени миниатюризации, однако в рассказах Азимова в значительной степени упускается из виду влияние этой миниатюризации на другие области техники. Например, картридеры отделения полиции в Пещеры из стали имеют емкость всего несколько килобайт на квадратный сантиметр носителя информации. Аврора, в частности, представляет собой последовательность исторических событий, которая объясняет отсутствие нанотехнологий - частичное реткон, в некотором смысле, временной шкалы Азимова.

Рэндалл Манро обсуждал Три закона в различных случаях, но, возможно, наиболее непосредственно в одном из своих комиксов под названием Три закона робототехники который воображает последствия каждого отдельного упорядочивания существующих трех законов.

Дополнительные законы

Есть три четвертых закона, написанные не Азимовым авторами. 1974 год Любен Дилов роман, Путь Икара (также известный как, Путешествие Икара) представил Четвертый закон робототехники:

Во всех случаях робот должен идентифицировать себя как робот.

Робот должен знать, что это робот.

Сюжет вращается вокруг убийства, в ходе которого судебно-медицинская экспертиза обнаруживает, что жертва была убита объятием человекоподобного робота. Робот нарушил как Первый закон, так и Четвертый закон Дилова (который во вселенной Кесаровски считается действующим), потому что он не подтвердил для себя, что это был робот. [31] Историю рассмотрел Валентин Дмитриевич Иванов в обзоре журнала SFF Портал. [32]

Робот должен воспроизводить. Пока такое воспроизведение не противоречит Первому, Второму или Третьему закону.

В книге активист по защите прав роботов, пытаясь освободить роботов, строит несколько роботов, оснащенных этим Четвертым законом. Роботы выполняют задачу, изложенную в этой версии Четвертого закона, создавая новых роботов, которые рассматривают роботов-создателей как родительские фигуры. [33]

В 2013 году Хутан Ашрафян предложил дополнительный закон, который впервые [ нужна цитата ] рассмотрели роль искусственного интеллекта в искусственном интеллекте или взаимосвязь между самими роботами - так называемый закон AIonAI. [34] Этот шестой закон гласит:

Все роботы, наделенные сопоставимым человеческим разумом и совестью, должны действовать по отношению друг к другу в духе братства.

Неясности и лазейки

Незнание нарушения законов

Неопределенность из-за отсутствия определения

В Лаки Старр и кольца Сатурна, роман, не имеющий отношения к Робот Джон Бигмен Джонс почти убит сирианским роботом по приказу своего хозяина. Общество Сириуса евгенически воспитано так, чтобы оно было одинаково высоким и похожим по внешнему виду, и поэтому, упомянутый хозяин может убедить робота, что гораздо более низкий Бигмен на самом деле не человек.

Разрешение противоречий между законами

Роботы Азимова, подчиняющиеся Трем законам (роботы Asenion), могут испытать необратимый психический коллапс, если они окажутся в ситуации, когда они не могут подчиняться Первому закону, или если они обнаружат, что неосознанно нарушили его. Первый пример этого режим отказа происходит в рассказе "Лжец!", который вводит сам Первый Закон и вводит неудачу по дилемме - в этом случае робот причинит вред людям, если он им что-то скажет, и причинит им боль, если он этого не сделает. [45] Этот режим отказа, который часто разрушает позитронный мозг без возможности восстановления, играет важную роль в фантастическом романе Азимова. Обнаженное солнце. Здесь Дэниел описывает действия, противоречащие одному из законов, но поддерживающие другой, как перегрузку некоторых цепей в мозгу робота - ощущение, эквивалентное боли у людей. Пример, который он использует, принудительно приказывает роботу выполнить задачу, выходящую за рамки его нормальных параметров, которую ему было приказано отказаться в пользу робота, специализированного для этой задачи. [46]

В Роботы Рассвета, утверждается, что создаются более продвинутые роботы, способные определять, какое действие более вредно, и даже выбирать случайным образом, если альтернативы одинаково плохи. Таким образом, робот способен совершить действие, которое можно интерпретировать как следование Первому закону, и избежать психического коллапса. Весь сюжет истории вращается вокруг робота, который, по-видимому, был уничтожен таким психическим коллапсом, и, поскольку его разработчик и создатель отказался делиться основной теорией с другими, он, по определению, единственный человек, способный обойти гарантии и ввергнуть робота в парадокс, разрушающий мозг.

В Роботы и Империя, Дэниел заявляет, что для него очень неприятно, когда принятие правильного решения занимает слишком много времени (с точки зрения роботов), и он не может представить себя без Законов вообще, за исключением того, что это похоже на это неприятное ощущение, только постоянное.

Читайте также: